计算机体系结构复习题

1.7 将计算机系统中某一功能的处理速度加快10倍,但该功能的处理时间仅为整个系统运行时间的40%,则采用此增强功能方法后,能使整个系统的性能提高多少?

解由题可知:可改进比例 = 40% = 0.4 部件加速比 = 10 根据Amdahl 定律可知:

()5625.110

4

.04.011

=+

-=系统加速比

采用此增强功能方法后,能使整个系统的性能提高到原来的1.5625倍。

1.8计算机系统中有三个部件可以改进,这三个部件的部件加速比为:

部件加速比1=30;部件加速比2=20;部件加速比3=10

(1) 如果部件1和部件2的可改进比例均为30%,那么当部件3的可改进比例为多少时,系统加速比才可以达到10?

(2) 如果三个部件的可改进比例分别为30%、30%和20%,三个部件同时改进,那么系统中不可加速部分的执行时间在总执行时间中占的比例是多少?

解:(1)在多个部件可改进情况下,Amdahl 定理的扩展:

∑∑

+-

=

i

i

i n S F F S )1(1

已知S 1=30,S 2=20,S 3=10,S n =10,F 1=0.3,F 2=0.3,得:

)

()(10/20/0.330/0.30.30.3-11

1033F F +++++=

得F 3=0.36,即部件3的可改进比例为36%。

(2)设系统改进前的执行时间为T ,则3个部件改进前的执行时间为:(0.3+0.3+0.2)T = 0.8T ,不可改进部分的执行时间为0.2T 。

已知3个部件改进后的加速比分别为S 1=30,S 2=20,S 3=10,因此3个部件改进后的执行时间为:

T T

T T T n 045.010

2.020

3.0303.0'=++=

改进后整个系统的执行时间为:Tn = 0.045T+0.2T = 0.245T

那么系统中不可改进部分的执行时间在总执行时间中占的比例是:

82.0245.02.0=T

T

3.4 设一条指令的执行过程分成取指令、分析指令和执行指令三个阶段,每个阶段所需的时间分别为△t 、△t 和2△t 。分别求出下列各种情况下,连续执行N 条指令所需的时间。

(1)顺序执行方式;

(2)只有“取指令”与“执行指令”重叠; (3)“取指令”、“分析指令”与“执行指令”重叠。 解:(1)每条指令的执行时间为:△t +△t +2△t =4△t

连续执行N 条指令所需的时间为:4N △t

(2)连续执行N 条指令所需的时间为:4△t +3(N-1)△t =(3N +1)△t (3)连续执行N 条指令所需的时间为:4△t +2(N-1)△t =(2N +2)△t 4.2 简述Tomasulo 算法的基本思想。

答:核心思想是:①记录和检测指令相关,操作数一旦就绪就立即执行,把发生RAW 冲突的可能性减小到最少;②通过寄存器换名来消除W AR 冲突和W AW 冲突。寄存器换名

是通过保留站来实现,它保存等待流出和正在流出指令所需要的操作数。

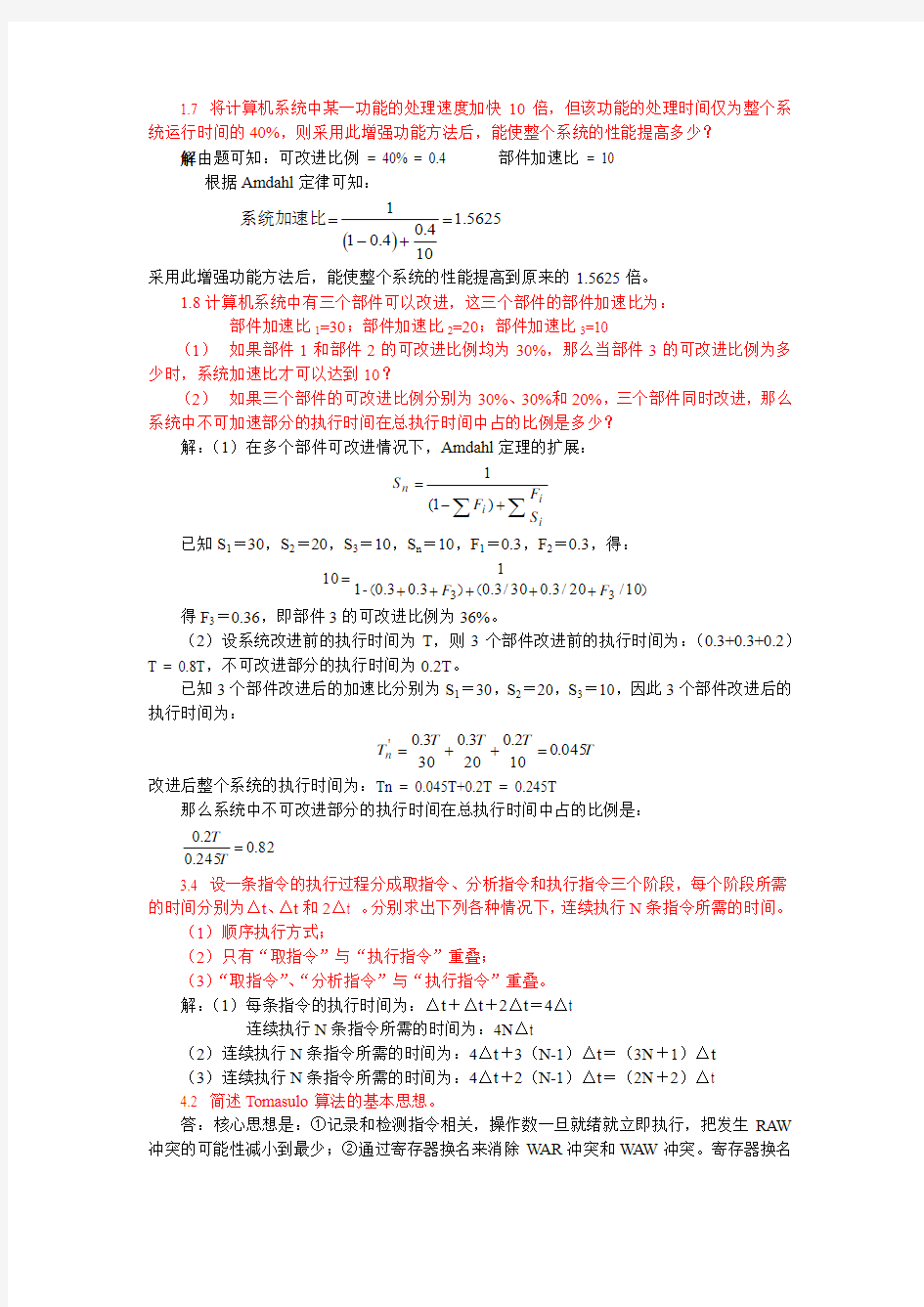

基本思想:只要操作数有效,就将其取到保留站,避免指令流出时才到寄存器中取数据,这就使得即将执行的指令从相应的保留站中取得操作数,而不是从寄存器中。指令的执行结果也是直接送到等待数据的其它保留站中去。因而,对于连续的寄存器写,只有最后一个才真正更新寄存器中的内容。一条指令流出时,存放操作数的寄存器名被换成为对应于该寄存器保留站的名称(编号)。 3.13有一个流水线由4段组成,其中每当流经第3段时,总要在该段循环一次,然后才能流到第4段。如果每段经过一次所需要的时间都是,问:

(1) 当在流水线的输入端连续地每时间输入任务时,该流水线会发生什么情况? (2) 此流水线的最大吞吐率为多少?如果每输入一个任务,连续处理10个任务

时的实际吞吐率和效率是多少? (3) 当每段时间不变时,如何提高该流水线的吞吐率?仍连续处理10个任务时,其

吞吐率提高多少?

解:(1)会发生流水线阻塞情况。

54.35%

92

5045T P E 2310

T n

T p 23T

21T P pipeline

pipeline max ≈=??=??==?=?=t t

t t

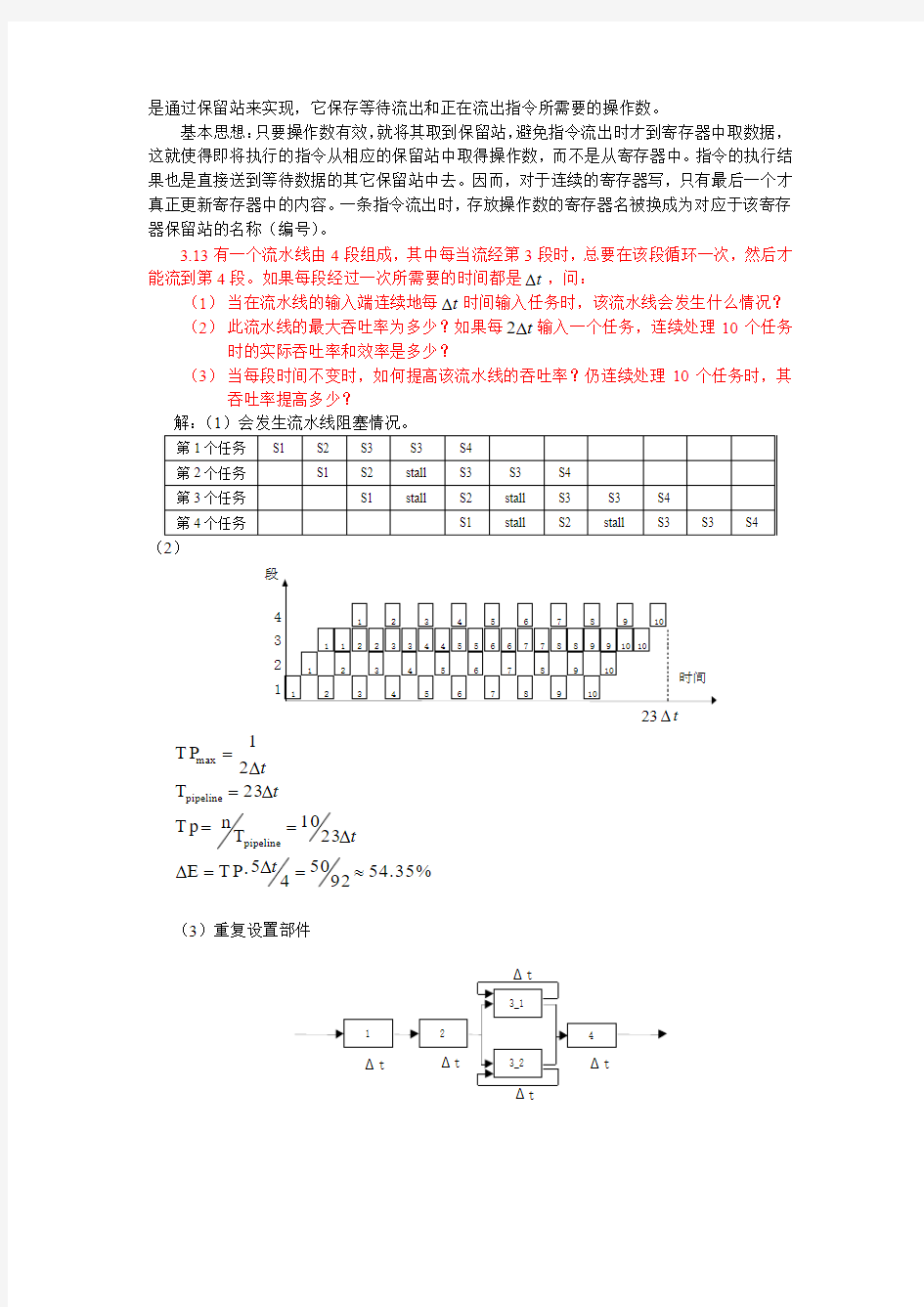

(3)重复设置部件

t ?t ?t ?2

23

t t ??=??==75

1410T n

T P pipeline

吞吐率提高倍数=t

t ??231075=1.64

3.17 假设各种分支指令数占所有指令数的百分比如下:

现有一条段数为4的流水线,无条件分支在第二个时钟周期结束时就被解析出来,而条件分支要到第三个时钟周期结束时才能够被解析出来。第一个流水段是完全独立于指令类型的,即所有类型的指令都必须经过第一个流水段的处理。请问在没有任何控制相关的情况下,该流水线相对于存在上述控制相关情况下的加速比是多少?

解:没有控制相关时流水线的平均CPI =1 存在控制相关时:由于无条件分支在第二个时钟周期结束时就被解析出来,而条件分支 要到第3个时钟周期结束时才能被解析出来。所以:

(1)若使用排空流水线的策略,则对于条件分支,有两个额外的stall ,对无条件分支,有一个额外的stall :

CPI = 1+20%*2+5%*1 = 1.45 加速比S=CPI/1 = 1.45

(2)若使用预测分支成功策略,则对于不成功的条件分支,有两个额外的stall ,对无条件分支和成功的条件分支,有一个额外的stall 1:

CPI = 1+20%*(60%*1+40%*2) +5%*1 = 1.33 加速比S=CPI/1 = 1.33

(3)若使用预测分支失败策略,则对于成功的条件分支,有两个额外的stall ;对无条件分支,有一个额外的stall ;对不成功的条件分支,其目标地址已经由PC 值给出,不必等待,所以无延迟:

CPI = 1+20%*(60%*2 + 40%*0) +5%*1 = 1.29 加速比S=CPI/1 = 1.29

4.4 假设有一条长流水线,仅仅对条件转移指令使用分支目标缓冲。假设分支预测错误的开销为4个时钟周期,缓冲不命中的开销为3个时钟周期。假设:命中率为90%,预测精度为90%,分支频率为15%,没有分支的基本CPI 为1。

(1) 求程序执行的CPI 。

(2) 相对于采用固定的2个时钟周期延迟的分支处理,哪种方法程序执行速度更快? 解:(1)程序执行的CPI = 没有分支的基本CPI (1) + 分支带来的额外开销 分支带来的额外开销是指在分支指令中,缓冲命中但预测错误带来的开销与缓冲没有命

段

t

? 14

中带来的开销之和。

分支带来的额外开销= 15% * (90%命中×10%预测错误×4 + 10%没命中×3)= 0.099 所以,程序执行的CPI = 1 + 0.099 = 1.099

(2)采用固定的2 个时钟周期延迟的分支处理CPI = 1 + 15%×2 = 1.3 由(1)(2)可知分支目标缓冲方法执行速度快。

4.9 设指令流水线由取指令、分析指令和执行指令3个部件构成,每个部件经过的时间为△t ,连续流入12条指令。分别画出标量流水处理机以及ILP 均为4的超标量处理机、超长指令字处理机、超流水处理机的时空图,并分别计算它们相对于标量流水处理机的加速比。

解:标量流水处理机的时空图:

执行完12条指令需T 1=14△t 。

超标量流水处理机与超长指令字处理机的时空图:

超标量流水处理机中,每一个时钟周期同时启动4条指令。执行完12条指令需T 2=5△t ,相对于标量流水处理机的加速比为:

8.2514212=?Λ==t

t T T S

超长指令字处理机中,每4条指令组成一条长指令,共形成3条长指令。执行完12条

指令需T 3=5△t ,相对于标量流水处理机的加速比为:

8.2514313=?Λ==t

t T T S

超流水处理机的时空图:

超标量处理机时空图

时间

超长指令字处理机时空图

超流水处理机中,每1/4个时钟周期启动一条指令。执行完12条指令需T 4=5.75△t ,相对于标量流水处理机的加速比为:

435.2.75514414=?Λ==t

t T T S

4、(10

分)假定我们有一台计算机,如果所有的cache 访问都命中的话,它的

CPI 是2.0。唯一的数据访问指令是store 和load ,它们占指令总数的40%,不命中损失是25个时钟周期,不命中率是2%。如果所有的指令访问cache 都命中的话,那么机器的速度是存在cache 不命中时的多少倍?

首先计算所有cache 访问都命中时计算机的性能: CPU 执行时间=(CPU 时钟周期+内存停机周期)×时钟周期时长 =(IC ×CPI +0)×时钟周期时长 = IC ×2.0×时钟周期时长

现在计算考虑cache 不命中在内的真实计算机性能,我们先计算内存停机周期: 内存停机周期=IC ×每条指令访问内存的次数×不命中率×不命中损失 =IC ×(1+0.4)×0.02×25 =IC ×0.7 其中(1+0.4)代表每条指令访问一次内存,而占指令总数40%的store 和load 访问两次内存,所以平均每条指令访问访问(1+0.4)次内存。这样总的性能是: CPU 执行时间=(IC ×2.0+IC ×0.7)×时钟周期时长 = IC ×2.7×时钟周期时长

性能提高的比是执行时间之比的倒数:

cache 不命中考虑在内的CPU 执行时间/cache 访问全部命中的CPU 执行时间为: 2.7×IC ×时钟周期时长/2.0×IC ×时钟周期时长=1.35

cache 访问全部命中时的速度是有cache 不命中时机器速度的1.35倍。

5、(10分)假设某台机器访问存储器都是cache 命中,那么它的CPI 等于2。还假设只

有Load 和Store 指令才能访问存储器数据,这两种指令的数目占整个程序的40%。如果访

问存储器时出现cache缺失,则一次缺失需要花费25个时钟周期。问这台机器在所有指令都cache命中情况比有2%缺失情况快几倍?

根据题意,在程序的执行过程中平均每条指令需要一次取指令和0.4次访问数据。因此,在有2% cache缺失时,由于cache缺失带来的额外开销为:

这台机器在所有指令都cache命中时,CPU执行时间为:

而在有2%缺失情况时,CPU执行时间为:

所以这台机器在所有指令都cache命中情况比有2%缺失情况快

1、(12分)在一台单流水线处理机上执行下面的程序。每条指令都要经过“取指令”、

“译码”、“执行”和“写结果”4个流水段,每个流水段的延迟时间都是5ns。执行部件的输出端有直接数据通路与它的输入端相连接,执行部件产生的条件码也直接送入控制器。

K1: MOVE R1, #4 ;R1←向量长度4

K2:LOOP:MOVE R2, A(R1) ;R2←A向量的一个元素

K3: ADD R0, R2 ;R0←(R0)+(R2)

K4: DNE R1, LOOP ;R1←(R1)-1,若(R1)≠0转向LOOP

K5: MOVE SUN,R0 ;SUN←(R0),保存结果

(1)列出指令之间的所有数据相关,包括读写、写读和写写数据相关。

(2)采用预测转移不成功的静态分支预测技术,画出指令流水线的时空图(可用指令

序号表示),并计算流水线的吞吐率、加速比和效率。

(3)采用预测转移成功的静态分支预测技术,计算指令流水线的吞吐率、加速比和效

率。

1、解:

(1)指令K1与指令K2之间关于R1的写读数据相关(第1次循环)

指令K1与指令K4之间关于R1的写读数据相关(第1次循环)

指令K1与指令K4之间关于R1的写写数据相关(第1次循环)

指令K2与指令K3之间关于R2的写读数据相关(每次循环内)

指令K2与指令K4之间关于R1的读写数据相关(第次循环内)

指令K3与指令K5之间关于R0的写读数据相关(最后一次循环)

另外,相邻循环体之间的数据相关还有:

指令K4与下一循环的指令K2之间关于R1的写读数据相关

指令K3与下一循环的指令K2之间关于R2的读写数据相关

指令K2与下一循环的指令K2之间关于R2的写写数据相关

指令K3与下一循环的指令K3之间关于R0的写读数据相关

指令K3与下一循环的指令K3之间关于R0的读写数据相关

指令K3与下一循环的指令K3之间关于R0的写写数据相关 指令K4与下一循环的指令K4之间关于R1的写读数据相关 指令K4与下一循环的指令K4之间关于R1的读写数据相关 指令K4与下一循环的指令K4之间关于R1的写写数据相关 (2)采用预测转移不成功的静态分支预测技术

写结果执行 译码 取指令61

.04234

)243(43.223

4

)243(235=??+?==?+?=?E S ns 效率:加速比:

(3)采用预测转移成功的静态分支预测技术 写结果执行 译码 取指令74

.04194

)243(95.219

4

)243()

(147195=??+?==?+?==?=

E S MIPS ns TP 效率:加速比:吞吐率:

4、(12分)某RISC 处理机的工作主频为500MHz ,有一个Cache 和一个主存储器,Cache 的存取周期为2ns ,主存储器的存取周期为20ns ,Cache 的命中率为99%,有20%的LOAD/STORE 指令,并假设处理机速度的瓶颈完全在存储系统。 (1)求理想情况(Cache 的命中率为100%)下的CPI 。 (2)计算该RISC 处理机的实际MIPS 速率。

(3)如果处理机的工作主频提高到1GHz ,计算实际CPI 和MIPS 速率。 4、解答:

(1) CPI=(2ns+2ns ?20%)?500MHz=1.2

(2) MIPS=1/(2ns ?99%+20ns ?1%+2ns ?20%?99%+20ns ?20%?1%)

=1/2.616ns=382.3

(3) CPI=(2ns ?99%+20ns ?1%+2ns ?20%?99%+20ns ?20%?1%)?1GHz

=2.616ns ?1GHz=2.616 MIPS=1/2.616ns=382.3

5.10 假设对指令Cache 的访问占全部访问的75%;而对数据Cache 的访问占全部访问的25%。Cache 的命中时间为1个时钟周期,失效开销为50 个时钟周期,在混合Cache 中一次load 或store 操作访问Cache 的命中时间都要增加一个时钟周期,32KB 的指令Cache 的失效率为0.39%,32KB 的数据Cache 的失效率为4.82%,64KB 的混合Cache 的失效率为1.35%。又假设采用写直达策略,且有一个写缓冲器,并且忽略写缓冲器引起的等待。试问

指令Cache 和数据Cache 容量均为32KB 的分离Cache 和容量为64KB 的混合Cache 相比,哪种Cache 的失效率更低?两种情况下平均访存时间各是多少?

解:(1)根据题意,约75%的访存为取指令。 因此,分离Cache 的总体失效率为:(75%×0.15%)+(25%×3.77%)=1.055%; 容量为128KB 的混合Cache 的失效率略低一些,只有0.95%。 (2)平均访存时间公式可以分为指令访问和数据访问两部分: 平均访存时间=指令所占的百分比×(读命中时间+读失效率×失效开销)+数据所占的百分比×(数据命中时间+数据失效率×失效开销)

所以,两种结构的平均访存时间分别为:

分离Cache 的平均访存时间=75%×(1+0.15%×50)+25%×(1+3.77%×50) =(75%×1.075)+(25%×2.885)=1.5275

混合Cache 的平均访存时间=75%×(1+0.95%×50)+25%×(1+1+0.95%×50) =(75%×1.475)+(25%×2.475)=1.725

因此,尽管分离Cache 的实际失效率比混合Cache 的高,但其平均访存时间反而较低。分离Cache 提供了两个端口,消除了结构相关。

5.11 给定以下的假设,试计算直接映象Cache 和两路组相联Cache 的平均访问时间以及CPU 的性能。由计算结果能得出什么结论?

(1) 理想Cache 情况下的CPI 为2.0,时钟周期为2ns ,平均每条指令访存1.2次; (2) 两者Cache 容量均为64KB ,块大小都是32字节; (3) 组相联Cache 中的多路选择器使CPU 的时钟周期增加了10%; (4) 这两种Cache 的失效开销都是80ns ; (5) 命中时间为1个时钟周期; (6) 64KB 直接映象Cache 的失效率为1.4%,64KB 两路组相联Cache 的失效率为1.0%。 解:平均访问时间=命中时间+失效率×失效开销 平均访问时间1-路=2.0+1.4% *80=3.12ns

平均访问时间2-路=2.0*(1+10%)+1.0% *80=3.0ns 两路组相联的平均访问时间比较低

CPU time =(CPU 执行+存储等待周期)*时钟周期

CPU time =IC (CPI 执行+总失效次数/指令总数*失效开销) *时钟周期 =IC ((CPI 执行*时钟周期)+(每条指令的访存次数*失效率*失效开销*时钟周期)) CPU time 1-way =IC(2.0*2+1.2*0.014*80)=5.344IC CPU time 2-way =IC(2.2*2+1.2*0.01*80)=5.36IC

相对性能比:

=--1way

time 2way time CPU CPU 5.36/5.344=1.003

直接映象cache 的访问速度比两路组相联cache 要快1.04倍,而两路组相联Cache 的平均性能比直接映象cache 要高1.003倍。因此这里选择两路组相联。

1. 3.12 有一指令流水线如下所示

(1) 求连续输入10条指令,该流水线的实际

吞吐率和效率; (2) 该流水线的“瓶颈”在哪一段?请采取两

种不同的措施消除此“瓶颈”。对于你所给出的两种新的流水线,连续输入10条指令时,其实际吞吐率和效率各是多少?

解:(1)

2200(ns)

2009200)10050(50t )1n (t

T max

m

1

i i

pipeline =?++++=?-+?=

∑=)

(ns 220

1

T n

T P 1pipeline

-==45.45%11

5

4400T P m

t

T P E m

1

i i

≈=?

=??

=∑= (2)瓶颈在3、4段。

出

50ns

50ns

50ns

50ns

50ns

? 变成八级流水线(细分)

850(ns)

509850t 1)(n t T max

m

1

i i pipeline =?+?=?-+?=∑=

)(ns 85

1

T n

T P 1pipeline

-==

58.82%17

10

8400T P m ti

T P E m

1

i ≈=?

=??

=∑= ? 重复设置

)(ns 85

1

T n

T P 1pipeline -==

58.82%

1710885010

400E ≈=??=

五、有5个中断源D1、D2、D3、D4、和D5,它们的中断优先级从高到低分别是1级、2级、3级、4级和5

级,这些中断源的中断优先级、正常情况下的中断屏蔽码和改变后的中断屏

1

段

蔽码见表4.5所示。每个中断源有5位中断屏蔽码,“O”表示该中断开放,“1”表示该中断被屏蔽。

1.当使用正常的中断屏蔽码时,处理机响应各中断源的中断服务请求的顺序是什么?

实际的中断处理次序是什么?

2.当使用改变后的中断屏蔽码时,处理机响应各中断源的中断服务请求的顺序是什

么?实际的中断处理次序是什么?

1)处理机响应各中断源的中断服务请求的顺序是D1,D2,D3,D4,D5,实际的中断处理次序是D1,D2,D3,D4,D5

2)处理机响应各中断源的中断服务请求的顺序是D1,D2,D3,D4,D5 实际的中断处理次序是D4,D5,D3,D2,D1

例1.3 如果FP操作的比例为25%,FP操作的平均CPI=4.0,其它指令的平均CPI为1.33,FPSQR操作的比例为2%, FPSQR的CPI为20。假设有两种设计方案,公别把FPSQR操作的CPI和所有FP操作的CPI减为2。试利用CPU性能公式比较这两种设计方案哪一个更好(只改变CPI而时钟频率和指令条数保持不变)。

解:原系统的CPI=25%×4+75%×1.33=2

方案1(使FPSQR操作的CPI为2)系统 CPI=CPI原-2%×(20-2)=2-2%×18=1.64

方案2(提高所有FP指令的处理速度)系统 CPI=CPI原-25%×(4-2)=2-25%×2=1.5

我们也可以根据以下公式计算出方案2系统的CPI CPI= 75%×1.33+25%×2=1.5

提高所有FP指令处理速度的方案要比提高FPSQR处理速度的方案要好。方案2的加速比=2/1.5= 1.33

例1.1 假设将某系统的某一部件的处理速度加快到10倍但该部件的原处理时间仅为整个运行时间的40%,则采用加快措施后能使整个系统的性能提高多少?

解:由题意可知:Fe=0.4, Se=10,根据Amdahl定律

作5.4 在一台单流水线多操作部件的处理机上执行下面的程序,取指令、指令译码各需要1

个时钟周期,MOVE,ADDT和MUL操作各需要2个、3个和4个时钟周期。每个操作都在第一个时钟周期从寄存器中读取操作数,在最后1个时钟周期把运算结果写到通用寄存器中。K: MOVE R1,R0 ; R1←R0

K+1:MUL R0 , R2 ,R1 ; R0← (R1)×( R2)

K+2:ADD R0,R2 , R3 ; R0← (R2) +( R3)

(1)就程序本身而言,可能有哪几种相关?

(2)在程序实际执行过程中,有哪几种相关会引起流水线的停顿?

(3)画出指令执行过程的流水线时空图,并计算机执行晚这3条指令共使用了多少个时钟周期?

解(1)

K: MOVE R1,R0 ; R1←R0

K+1:MUL R0 , R2 ,R1 ; R0← (R1)×( R2)

K+2:ADD R0,R2 , R3 ; R0← (R2) +( R3)

K、K+1 存在写读相关,读写相关;

K+1、K+2存在写写相关。

(2)K、K+1 的写读相关,会引起流水线的停顿;

K+1、K+2的写写相关会引起流水线的停顿。

例 3.2 假设前面 DLX 非流水线实现的时钟周期时间为10ns,ALU和分支操作需要4个时钟周期,访问存储器操作需5个时钟周期,上述操作在程序中出现的相对频率分别是:40%、20%和40%。在基本的DLX流水线中,假设由于时钟扭曲和寄存器建立延迟等原因,流水线要在其时钟周期时间上附加1ns的额外开销。现忽略任何其它延迟因素的影响,请问:相对于非流水实现而言,基本的DLX流水线执行指令的加速比是多少?

解:当非流水执行指令时,指令的平均执行时间为

TPI非流水= 10 ns×((40% + 20%)×4 + 40%×5)= 10 ns× 4.4= 44 ns

在流水实现中,指令执行的平均时间是最慢一段的执行时间加上额外开销,即

TPI流水= 10ns + 1ns = 11ns

所以基本的DLX流水线执行指令的加速比为S = TPI非流水/ TPI流水 = 44 ns / 11ns = 4

流水线的额外开销对其性能也有较大影响,这些额外开销主要来自于流水线寄存器的延迟和时钟扭曲。流水线寄存器或锁存器具有一定的建立时间和传输延迟,这些延迟加长了流水线的时钟周期时间

计算机体系结构论文

计算机体系结构论文 论文题目:计算机系统结构中多处理机技术姓名:XXX 班级:XXX 学号:XXXX

摘要:多处理机是指能同时执行多个进程的计算机系统.多处理机通过共享的主存或输入/输出子系统或高速通信网络进行通信。利用多台处理机进行多任务处理,协同求解一个大而复杂的问题来提高速度,或者依靠冗余的处理机及其重组能力来提高系统的可靠性、适应性和可用行。该文介绍了微处理器的发展、多处理机的总线以及处理机系统中通信和存储技术的发展和两种特殊的多处理机系统结构,以及现今几种典型的并行计算机体系结构及处理机分配与调度策略。而本篇论文主要根据所阅读的文章进行扩展延伸,主要介绍了多处理机技术,它的总线以及分配调度方面。 关键字:多处理机;体系结构;总线;调度 引言: 微电子技术和封装技术的进步,使得高性能的VLSI微处理器得以大批量生产,性能价格比不断合理,这为并行多处理机的发展奠定了重要的物质基础。计算机系统性能增长的根本因素有两个:一个是微电子技术,另一个是计算机体系结构技术。五十年代以来,人们先后采用了先行控制技术、流水线技术、增加功能部件甚至多机技术、存储寻址和管理能力的扩充、功能分布的强化、各种互联网络的拓扑结构以及支持多道、多任务的软件技术等_系列并行处理技术,提高计算机处理速度,增强系统性能。多处理机体系结构是计算机体系结构发展中的一个重要内容,已成为并行计算机发展中人们最关注的结构。 多处理机的介绍: 多处理机是指能同时执行多个进程的计算机系统。 由于超大规模集成电路(VLSI)技术迅速发展的结果,多处理技术能够充分地发挥高性能的32位微处理机的有效性,用大量低价格的部件配置高性能的计算机结构系统.以典型的

计算机系统结构三四章作业及答案

3.1 简述流水线技术的特点。(1) 流水线把一个处理过程分解为若干个子过程,每个子过程由一个专门的功能部件来实现。因此,流水线实际上是把一个大的处理功能部件分解为多个独立的功能部件,并依靠它们的并行工作来提高吞吐率。(2) 流水线中各段的时间应尽可能相等,否则将引起流水线堵塞和断流。(3) 流水线每一个功能部件的前面都要有一个缓冲寄存器,称为流水寄存器。(4) 流水技术适合于大量重复的时序过程,只有在输入端不断地提供任务,才能充分发挥流水线的效率。(5) 流水线需要有通过时间和排空时间。在这两个时间段中,流水线都不是满负荷工作。 3.2 解决流水线瓶颈问题有哪两种常用方法?答:细分瓶颈段与重复设置瓶颈段 3.3 有一条指令流水线如下所示: (1 用两给出条指 (1) (24? 变八级流水线(细分) ? 重复设置部件 )(ns 85 1 T n TP 1pipeline -== 3.4 有一个流水线由4段组成,其中每当流过第三段时,总要在该段循环一次,然后才能流到第4段。如果每段经过一次所需的时间都是△t ,问: (1)当在流水线的输入端连续地每△t 时间输入一个任务时,该流水线会发生什么情况? (2)此流水线的最大吞吐率为多少?如果每2△t 输入一个任务,连续处理10个任务时,其实际吞吐率和效率是多少? (3)当每段时间不变时,如何提高流水线的吞吐率?人连续处理10个任务时,其吞吐率提高多少? 解:(1)会发生流水线阻塞情况。

(2) (3)重复设置部件 吞吐率提高倍数= t t ??2310 75 =1.64 3.5 有一条动态多功能流水线由5段组成,加法用1、3、4、5段,乘法用1、2、5段,第2段的时间为2△t ,其余各段的时间均为△t ,而且流水线的输出可以直接返回输入端或暂存于相应的流水线寄存器中。现在该流水线上计算 ∏=+4 1 )(i i i B A ,画出时空图,并计算其吞吐率、加速比和效率。 +B 4;再计算由图可见,它在18个△t 时间中,给出了7个结果。所以吞吐率为: 如果不用流水线,由于一次求积需3△t ,一次求和需5△t ,则产生上述7个结果共需(4×5+3×3)△t =29△t 。所以加速比为: 该流水线的效率可由阴影区的面积和5个段总时空区的面积的比值求得: 3.6 在一个5段流水线处理机上,各段执行时间均为△t,需经9△t 才能完成一个任务,其预约表如下所示。 段23 时间 入 A 1 B 1 A 2 B 2 A 3 B 3 A 4 B 4 A B C D A × B C ×D

计算机体系结构期末复习

计算机体系结构期末复习资料 1.并行性:是指在同一时刻或者是同一时间间隔内完成两种或两种以上性质相同或不同的工作。 2.CPI:每条指令执行时所花费的平均时钟周期。 3.体系结构:即计算机的属性,即概念性结构与功能特性。 4.Amdahl定理:加快某部件执行速度所获得的系统性能加速比,受限于该部件在系统中所占的重要性。 5.信息存储的整数边界:信息在主存中存放的起始地址必须是该信息(字节数)的整数倍。 6.指令系统的正交性:指在指令中各个不同含义的字段,在编码时应互不相关,相互独立。 7.流水线技术:是指将一个重复的时序过程,分解成为若干子过程,而每个过程都可有效在其专用功能段上与其他子过程同时执行。 8.定向技术:在某条指令产生一个结果之前,其他指令并不直接需要该计算结果,如果能将该计算结果从其他产生的地方直接送到其他指令需要它的地方,那么就可以避免暂停的技术就叫定向技术。 9.相关:衡量两个随机变量之间相关程度的指标。 10.向量流水处理机:是指处理机具有向量数据表示并通过向量指令对向量的各元素进行处理。、

11.定向:将计算结果从其产生的地方直接送到其他指令需要它的地方,或所有需要它的功能单元,避免暂停。 12.指令集的并行:当指令之间不存在相关时,它们在流水线中是可以重叠起来并行执行。 13.记分牌技术:流出和读操作数。在没有结构冲突时,尽可能早地执行没有数据冲突的指令,实现每个时钟周期执行一条指令。如果某条指令被暂停,而后面的指令与流水线中正在执行或被暂停的指令都不相关,是这些指令可以跨越它,继续流出和执行下去。 14.Tomasulo算法:寄存器换名是通过保留站和流出逻辑来共同完成,当指令流出时,如果其操作数还没有计算出来,则该指令中相应的寄存器换名将产生这个操作数的保留站的标识。因此,指令流出到保留站后,其操作数寄存器或者换成了数据本身,或换成了保留站的标识,和寄存器无关。后面指令对该寄存器的写入操作就不会产生WAR冲突。 15.替换算法:由于主存中的块比Cache中的块多,所以当要从主存中调一个块到Cache中时,会出现该块所映象到的一组(或一个)Cache块已全部被占用的情况。这时,需要被迫腾出其中的某一块,以接纳新调入的块。

第一章 计算机网络体系结构

(答案仅供参考如有不对请自己加以思考) 第一章计算机网络体系结构 一、习题 1.比特的传播时延与链路带宽的关系()。 A.没有关系 B. 反比关系 C. 正比关系 D. 无法确定 2.计算机网络中可以没有的是()。 A. 客服机 B. 操作系统 C. 服务器 D.无法确定 3.在OSI参考模型中,提供流量控制的层是第(1)层;提供建立、维护和拆除端到端连接的层是(2);为数据分组提供在网络中路由功能的是(3);传输层提供(4)的数据传送;为网络层实体提供数据发送和接收功能和过程的是(5)。 (1)A. 1、2、3 B. 2、3、4 C. 3、4、5 D. 4、5、6 (2)A. 物理层 B. 数据链路层 C. 会话层 D. 传输层 (3)A. 物理层 B. 数据链路层 C. 网络层 D.传输层 (4)A. 主机进程之间 B. 网络之间 C. 数据链路层 D. 物理线路层 (5)A. 物理层 B. 数据链路层 C. 会话层 D. 传输层 4.计算机网络的基本分类方法主要有两种:一种是根据网络所使用的传输技术;另一种是根据()。 A. 网络协议 B. 网络操作系统 C. 覆盖范围与规模 D. 网络服务器类型与规模 5.计算机网络从逻辑功能上可分为()。 Ⅰ.资源子网Ⅱ.局域网Ⅲ.通信子网Ⅳ.广域网 A.Ⅱ、Ⅳ B.Ⅰ、Ⅲ B. Ⅰ、Ⅳ D. Ⅲ、Ⅳ 6. 计算机网络最基本的功能是()。 Ⅰ. 流量控制Ⅱ.路由选择 Ⅲ. 分布式处理Ⅳ. 传输控制 A. Ⅰ、Ⅱ、Ⅳ B.Ⅰ、Ⅲ、Ⅳ C. Ⅰ、Ⅳ D. Ⅲ、Ⅳ 7.世界上第一个计算机网络是()。 A.ARPANET B. 因特网 C. NSFnet D. CERNET 8. 物理层、数据链路层、网络层、传输层的传输单位(或PDU)分别是()。 Ⅰ.帧Ⅱ. 比特Ⅲ.报文段Ⅳ.数据报 A.Ⅰ、Ⅱ、Ⅳ、Ⅲ B. Ⅱ、Ⅰ、Ⅳ、Ⅲ C. Ⅰ、Ⅳ、Ⅱ、Ⅲ D. Ⅲ、Ⅳ、Ⅱ、Ⅰ 9.设某段电路的传播时延是10ms,带宽为10Mbit/s,则该段电路的时延带宽积为()。 A.2×105 bit B.4×105 bit C.1×105 bit D. 8×105 bit

计算机系统结构网上作业

计算机系统结构作业参考答案 一、 1、试述现代计算机系统的多级层次结构。 计算机系统具有层次性,它由多级层次结构组成。从功能上计算机系统可分为五个层次级别:第一级是设计级。这是一个硬件级,它由机器硬件直接执行。 第二级是一般机器级,也称为机器语言级。它由微程序解释系统.这一级是硬件级。 第三级是操作系统级,它由操作系统程序实现。这些操作系统由机器指令和广义指令组成,这些广义指令是操作系统定义和解释的软件指令。这一级也称混合级。 第四级是汇编语言级。它给程序人员提供一种符号形式的语言,以减少程序编写的复杂性。这一级由汇编程序支持执行。 第五级是高级语言级。这是面向用户为编写应用程序而设置的。这一级由各种高级语言支持。 2、试述RISC设计的基本原则和采用的技术。 答:一般原则: (1)确定指令系统时,只选择使用频度很高的指令及少量有效支持操作系统,高级语言及其它功能 的指令,大大减少指令条数,一般使之不超过100条; (2)减少寻址方式种类,一般不超过两种; (3)让所有指令在一个机器周期内完成; (4)扩大通用寄存器个数,一般不少于32个,尽量减少访存次数; (5)大多数指令用硬联实现,少数用微程序实现; (6)优化编译程序,简单有效地支持高级语言实现。

基本技术: (1)按RISC一般原则设计,即确定指令系统时,选最常用基本指令,附以少数对操作系统等支持最有用的指令,使指令精简。编码规整,寻址方式种类减少到1、2种。 (2)逻辑实现用硬联和微程序相结合。即大多数简单指令用硬联方式实现,功能复杂的指令用微程序实现。 (3)用重叠寄存器窗口。即:为了减少访存,减化寻址方式和指令格式,简有效地支持高级语言中的过程调用,在RISC机器中设有大量寄存嚣,井让各过程的寄存器窗口部分重叠。 (4)用流水和延迟转移实现指令,即可让本条指令执行与下条指令预取在时间上重叠。另外,将转移指令与其前面的一条指令对换位置,让成功转移总是在紧跟的指令执行之后发生,使预取指令不作废,节省一个机器周期。 (5)优化设计编译系统。即尽力优化寄存器分配,减少访存次数。不仅要利用常规手段优化编译,还可调整指令执行顺序,以尽量减少机器周期等。 3、试述全相联映像与直接映像的含义及区别 (1)全相连映像 主存中任何一个块均可以映像装入到Cache中的任何一个块的位置上。主存地址分为块号和块内地址两部分,Cache地址也分为块号和块内地址。Cache的块内地址部分直接取自主存地址的块内地址段。主存块号和Cache块号不相同,Cache块号根据主存块号从块表中查找。Cache保存的各数据块互不相关,Cache必须对每个块和块自身的地址加以存储。当请求数据时,Cache控制器要把请求地址同所有的地址加以比较,进行确认。 (2)直接映像 把主存分成若干区,每区与Cache大小相同。区内分块,主存每个区中块的大小和Cache 中块的大小相等,主存中每个区包含的块的个数与Cache中块的个数相等。任意一个主存块只能映像到Cache中唯一指定的块中,即相同块号的位置。主存地址分为三部分:区号、块号和块内地址,Cache地址分为:块号和块内地址。直接映像方式下,数据块只能映像到Cache中唯一指定的位置,故不存在替换算法的问题。它不同于全相连Cache,地址仅需比较一次。 (3)区别: 全相连映像比较灵活,块冲突率低,只有在Cache中的块全部装满后才会出现冲突,Cache 利用率高。但地址变换机构复杂,地址变换速度慢,成本高。 直接映像的地址变换简单、速度快,可直接由主存地址提取出Cache地址。但不灵活,块冲突率较高,Cache空间得不到充分利用。 4. 画出冯?诺依曼机的结构组成?

系统结构期末考试试题及答案

得分 评分人 填空题: (20分,每题2 分) 单选题:(10分,每题1分) A.任何虚页都可装入主存中任何实页的位置 B. 一个虚页只装进固定的主存实页位置 《计算机系统结构》期末考试试卷(A ) 得分 注:1、共100分,考试时间120分钟。 2、此试卷适用于计算机科学与技术本科专业。 1、."启动I/O"指令是主要的输入输出指令,是属于( A. 目态指令 B.管态指令 C.目态、管态都能用的指令 D.编译程序只能用的指令 2、 输入输出系统硬件的功能对 (B )是透明的 A.操作系统程序员 B.应用程序员 C.系统结构设计人员 D.机器语言程序设计员 3、 全相联地址映象是指(A ) C. 组之间固定,组内任何虚页可装入任何实页位置 D.组间可任意装入,组内是固定装入 4、( C ) 属于MIMD 系统结构 A.各处理单元同时受一个控制单元的管理 B.各处理单元同时受同个控制单元送来的指令 C.松耦合多处理机和多计算机系统 D. 阵列处理机 5、多处理机上两个程序段之间若有先写后读的数据相关,则( B ) A.可以并行执行 B.不可能并行 C.任何情况均可交换串行 D.必须并行执行 6、 计算机使用的语言是(B ) A.专属软件范畴,与计算机体系结构无关 B.分属于计算机系统各个层次 C.属于用以建立一个用户的应用环境 D. 属于符号化的机器指令 7、 指令执行结果出现异常引起的中断是( C ) A.输入/输出中断 B.机器校验中断 C.程序性中断 D.外部中断 &块冲突概率最高的 Cache 地址映象方式是(A ) A.直接 B .组相联 C .段相联 D .全相联 9、 组相联映象、LRU 替换的Cache 存储器,不影响 Cache 命中率的是(B ) A.增大块的大小 B .增大主存容量 C .增大组的大小 D .增加Cache 中的块数 10、 流水处理机对全局性相关的处理不 包括(C ) A.猜测法 B.提前形成条件码 C.加快短循环程序的执行 D.设置相关专用通路

计算机系统结构第一章自考练习题答案

第一章计算机系统结构的基本概念 历年真题精选 1. 下列对系统程序员不透明的是()。 A. 乘法器 B. 先行进位链 C. 指令缓冲器 D. 条件码寄存器2.“从中间开始”设计的“中间”目前多数是在( D )。 A. 微程序机器级与汇编语言机器级之间 B. 操作系统机器级与汇编语言机器级之间 C. 传统机器语言机器级与微程序机器级之间 D. 传统机器语言机器级与操作系统机器级之间 3. 开发计算机系统结构并行性的主要技术途径有时间重叠、(资源重复)和(资源 共享)。 4. 计算机系统弗林分类法,把计算机系统分成单指令流单数据流(SISD)、单指令流多数 据流(SIMD)、(多指令流单数据流(MISD))和(多指令流多数据流(MIMD))四大类。 5. 设计指令系统时,以乘法运算为例,简述系统结构设计、计算机组成设计、计算机实现 各应考虑的问题。( P4) 6. 实现软件移植的途径有哪些各受什么限制( P14) 同步强化练习 一.单项选择题。 1. 实现汇编语言源程序变换成机器语言目标程序是由( C )。 A. 编译程序翻译 B. 编译程序解释 C. 汇编程序翻译 D. 汇编程序解释 2. 系列机软件应做到( B ) A. 向前兼容,并向下兼容 B. 向后兼容,力争向上兼容 C. 向前兼容,并向上兼容 D. 向后兼容,力争向下兼容 3. 在计算机系统多级层次结构中,机器级由低到高,相对顺序正确的应当是( B )。 A. 传统机器语言、汇编语言、操作系统 B. 微程序、传统机器语言、高级语言 C. 高级语言、汇编语言、传统机器语言 D. 传统机器语言、应用语言、高级语言 4. 可以直接执行微指令的是( C )。 A. 编译程序 B. 微程序 C. 硬件 D. 汇编程序 5. 计算机系统结构不包括( A )。 A. 主存速度 B. 数据表示 C. 机器工作状态 D. 信息保护 6. 对计算机系统结构透明的是()。 A. 是否使用通道型I/0处理机 B. 虚拟存储器 C. 字符行运算指令 D. VLSI技术 7. 在主存设计上,属计算机系统结构考虑的应是( C )。 A. 频宽的确定 B. 多体交叉还是单体 C. 容量和编址单位 D. 用MOS还是TTL 8. 计算机组成设计不考虑( B )。 A. 缓冲技术 B. 功能部件的集成度 C. 专用部件设置 D. 控制机构的组成

计算机系统结构论文

计算机系统结构论文 计算机系统结构中多处理机技术 摘要:多处理机通过共享的主存或输入/输出子系统或高速通信网络进行通信。利用多台处理机进行多任务处理,协同求解一个大而复杂的问题来提高速度,或者依靠冗余的处理机及其重组能力来提高系统的可靠性、适应性和可用行。该文介绍了微处理器的发展、多处理机的总线以及处理机系统中通信和存储技术的发展和两种特殊的多处理机系统结构。 关键词:多处理机;体系结构;总线 微电子技术和封装技术的进步,使得高性能的VLSI 微处理器得以大批量生产,性能价格比不断合理,这为并行多处理机的发展奠定了重要的物质基础。 计算机系统性能增长的根本因素有两个:一是微电子技术,另一个是计算机体系结构技术。五十年代以来,人们先后采用了先行控制技术、流水线技术、增加功能部件甚至多机技术、存储寻址和管理能力的扩充、功能分布的强化、各种互联网络的拓扑结构以及支持多道、多任务的软件技术等一系列并行处理技术,提高计算机处理速度,增强系统性能。多处理机体系结构是计算机体系结构发展中的一个重要内容,已成为并行计算机发展中人们最关注的结构。

1 微处理器的发展 20 世纪80 年代中期,RISC 精简指令集计算机,用20%指令的组合实现了CISC 计算机指令系统不常用的80%指令的功能。在提高性能方面,RISC 采用了超级流水线、超级标量、超长指令字并行处理结构;多级指令Cache;编译优化等技术,充分利用RISC 的内部资源,发挥其内部操作的并行性,从而提高流水线的执行效率。20 世纪80 年代后期,RISC 处理机的性能指标几乎以每年翻一番的速度发展,它对于提高计算机系统的性能和应用水平起着巨大的作用。 目前,由Intel 和HP 两家公司联合开发的基于IA—64 架构的Merced 芯片,并由其共同定义的显式并行指令计算技术EPIC(Explicitly Parallel Instruction Computing ),将为微处理器技术的发展带来突破性进展。EPIC 技术主要指编译器在微处理器执行指令之前就对整个程序的代码作出优化安排,编译器分析指令间的依赖关系,将没有依赖关系的指令(最多3 个)组成一“组”,由Merced内置的执行单元读入被分成组的指令群并执行。从理论上讲,EPIC 可以并行执行3 倍于执行单元数的指令。64 位体系结构的Merced 芯片还采用了指令预测、数据预装等技术,可以显著地减少实际执行程序的长度,同时增强语句执行的并行性,经过代码的重组,程序的执行时间比基于传统体系结构

计算机体系结构知识点

目录 第一章计算机系统结构基本概念 (2) (一) 概念 (2) (二) 定量分析技术 (3) (三) 计算机系统结构发展 (4) (四) 计算机的并行性 (5) 第二章计算机指令集结构 (7) 一. 指令集结构的分类 (7) 二. 寻址方式 (7) 三. 指令集结构的功能设计 (8) 四. 指令格式的设计 (10) 五. MIPS指令集结构 (10) 第三章流水线技术 (14) 一. 流水线的基本概念 (14) 二. 流水线的性能指标 (14) 三. 流水线的相关与冲突 (16) 四. 流水线的实现 (18) 第四章指令集并行 (18) 付志强

第一章计算机系统结构基本概念 (一)概念 什么是计算机系统结构:程序员所看到的计算机属性,即概念性结构与功能特性. 透明性:在计算机技术中,把本来存在的事物或属性,但从某种角度看又好像不存在的概念成为透明性. 常见计算机系统结构分类法 冯氏分类法(冯泽云):按最大并行度对计算机进行分类. Flynn分类法:按指令流和数据流多倍性进行分类 ①单指令流单数据流 ②单指令流多数据流 ③多指令流单数据流(不存在) ④多指令流多数据流 付志强

(二)定量分析技术 Amdahl定律:加快某部件执行速度所能获得的系统性能加速比,受限于该部件的执行时间占系统中总执行时间的百分比. 加速比=系统性能 改进后 系统性能 改进前 = 总执行时间 改进前 总执行时间 改进后 加速比依赖于以下两个因素 ①可改进比例 ②部件加速比 CPU性能公式 CPU时间 CPU时间=执行程序所需时间的时钟周期数x时钟周期时间(系统频率倒数) CPI(Cycles Per Instruction) CPI =执行程序所需时钟周期数/所执行指令条数 ∴CPU时间= IC x CPI x 时钟周期时间 可知CPU性能取决于一下三个方面 ①时钟周期时间:取决于硬件实现技术和计算机组成 付志强

高级计算机体系结构作业汇总(非标准答案)

1.Explain the Concepts Computer Architecture 系统结构 由程序设计者所看到的一个计算机系统的属性。即计算机系统的软硬件界面。 Advanced CA 高级系统结构 新型计算机系统结构。基于串行计算机结构,研究多指令多数据计算机系统,具有并发、可扩展和可编程性。为非冯式系统结构。 Amdahl law Amdahl定律 系统中某部件由于采用某种方式时系统性能改进后,整个系统性能的提高与该方式的使用频率或占的执行时间的比例有关。 SCALAR PROCESSING 标量处理机 在同一时间内只处理一条数据。 LOOK-AHEAD 先行技术 通过缓冲技术和预处理技术,解决存储器冲突,使运算器能够专心与数据的运算,从而大幅提高程序的执行速度。 PVP 向量型并行计算处理机 以流水线结构为主的并行处理器。 SMP 对称多处理机系统 任意处理器可直接访问任意内存地址,使用共享存储器,访问延迟、带宽、机率都是等价的。MPP 大规模并行计算机系统 物理和逻辑上均是分布内存,能扩展至成百上千处理器,采用专门设计和定制的高通信带宽和低延迟的互联网络。 DSM 分布式共享存储系统 内存模块物理上局部于各个处理器内部,但逻辑上是共享存储的。 COW 机群系统 每个节点都是一个完整的计算机,各个节点通过高性能网络相互连接,网络接口和I/O总线松耦合连接,每个节点有完整的操作系统。 GCE 网格计算环境 利用互联网上的计算机的处理器闲置处理能力来解决大型计算问题的一种科学计算。 CISC 复杂指令集计算机

通过设置一些复杂的指令,把一些原来由软件实现的常用功能改用硬件实现的指令系统实现,以此来提高计算机的执行速度。 RISC 精简指令集计算机 尽量简化计算机指令功能,只保留那些功能简单,能在一个节拍内执行完的指令,而把复杂指令用段子程序来实现。 VMM 虚拟机监视器 作为软硬件的中间层,在应用和操作系统所见的执行环境之间。 SUPERCOMPUTER 超级计算机 数百数千甚至更多的处理器组成的能计算普通计算机不能完成的大型复杂问题的计算机。SVM 共享虚拟存储器 存储器虚拟化为一个共享的存储器,并提供单一的地址空间。 MAINFRAME 大型计算机 作为大型商业服务器,一般用于大型事务处理系统,特别是过去完成的且不值得重新编写的数据库应用系统方面。 COMPUTER SYSTEM ON CHIP 片上计算机系统 在单个芯片上集成的一个完整系统。 PARALLEL ARCHITECTURE INTO SINGLE CHIP 单片并行结构 在单个芯片上采用的并行体系结构 MOORE law Moore定律 当价格不变时,集成电路上可容纳的晶体管数目,约每隔18个月便会增加一倍,性能也将提升一倍。 UMA 一致存储访问 采用集中式存储的模式,提供均匀的存储访问。 NUMA 非一致存储访问 内存模块局部在各个结点内部,所有局部内存模块构成并行机的全局内存模块。 COMA 全高速缓存存储访问 采用分布式存储模式,通过高速缓存提供快速存储访问。 CC-NUMA 全高速缓存非一致性均匀访问 存在专用硬件设备保证在任意时刻,各结点Cache中数据与全局内存数据的一致性。NORMA 非远程存储访问

计算机系统结构期末考试题目

第一章: 1.计算机系统结构的定义 答:由程序设计者看到的一个计算机系统的属性,即概念性结构和功能特性。 2.透明性概念 答:在计算机技术中,一种本来是存在的事物或属性,但从某种角度看似乎不存在,称为透明性现象。 3.兼容性向后兼容 兼容性:同一个软件可以不加修改地运行于系统结构相同的各档机器,可获得相同的结果,差别只在于不同的运行时间。 向后兼容:按某个时期投入市场的某种型号机器编制的程序,不加修改就能运行于在它之后投入市场的机器。 4.Amdahl定律 答:系统中某一部件由于采用某种更快的执行方式后整个系统性能的提高与这种执行方式的使用频率或占总执行时间的比例有关。 5.CPI 答:每条指令的平均时钟周期数。 6.MIPS 答:每秒百万条指令数!MIPS=时钟频率/(CPI*10^6) 7.MFLOPS 答:每秒百万次浮点操作次数。MFLOPS=程序中的浮点操作次数/(执行时间*10^6) 8.命中率的概念 答: 9.Flynn分类法是按指令流和数据流的多倍性特征进行计算机系统结构的划分 答:①单指令流单数据流SISD ②单指令流多数据流SIMD ③多指令流单数据流MISD(实际不存在)④多指令流多数据流MIMD 10.计算机系统设计的定量原理(四个) 答:①加快经常性事件的速度②Amdahl定律③CPU性能公式④访问的局部性原理11.CPI和加速比的计算 答:CPI=CPU时钟周期数/IC CPU时间=CPU时钟周期数/频率 CPU时间=CPU时钟周期*时钟周期长 加速比=(采用改进措施后的性能)/(没有采用改进措施前的性能) =(没有采用改进措施前执行某任务的时间)/(采用改进措施后执行某任务的时间) 12.软硬件实现的特点 硬件实现:速度快、成本高;灵活性差、占用内存少 软件实现:速度低、复制费用低;灵活性好、占用内存多 13.系统评价的标准 ①运算速度②存储器系统③其他性能④成本标准

第一章 计算机网络体系结构(题目)

第一章计算机网络体系结构 【例 1.1】计算机网络可以被理解为() A.执行计算机数据处理的软件模块 B.由自主计算机互连起来的集合体 C.多个处理器通过共享内存实现的紧耦合系统 D.用于共同完成一项任务的分布式系统 【例 1.2】广域网中广泛采用的拓扑结构是() A.树型 B.网状 C星型 D.环型 【例 1.3】局域网与广域网之间的差异不仅仅在于它们所能覆盖的地理范围不同,而且还在于() A.所使用的传输介质不同 B.所提供的服务不同 C.所能支持的通信量不同 D.所使用的协议不同 【例 1.4】OSI参考模型中,网络层、数据链路层和物理层传输的协议数据单元(PDU)分别称为() A. 报文(message)、帧(frame)、比特(bit) B. 分组(packet)、报文(message)、比特(bit) C. 分组(packet)、帧(frame)、比特(bit) D. 数据报(datagram)、帧(frame)、比特(bit) 【例 1.5】在TCP/IP协议簇的层次中,解决计算机之间通信问题的是() A.网络接口层 B.网络层 C.运输层 D.应用层 【例 1.6】在OSI参考模型中,服务原语可划分为4类,包括请求、指示、响应和() A.答复 B.确认 C.应答 D.接收 【例 1.7】一个系统的协议结构有N层,应用程序产生M字节长的报文,

网络软件在每层加上h字节的协议头,网络带宽中有多大比率用于协议头信息的传输? 【例 1.8】请描述OSI模型中数据流动的过程。 精选试题练习 【题 1.1】计算机网络可以被看成是自治的计算机系统的集合,其中“自治的计算机”主要指() A.可以独立运行的计算机 B.网络计算机 C.裸机 D.网络终端 【题 1.2】将计算机与计算机之间连接起来实现资源共享和数据通信,属于计算机网络发展的() A.联机系统阶段 B.计算机网络阶段 C.标准化网络阶段 D.网络互连和高速网络阶段 【题 1.3】计算机网络中可以共享的资源包括() A.客户机和服务器 B.硬件、软件和数据 C.主机、CPU、内存和外部设备 D.计算机和传输介质 【题 1.4】一下不属于协议的三要素的是() A.语法 B.语义C.时序 D.异步 【题1.5】通信协议包括了对通信过程的说明,规定了应当发出哪些控制信息,完成哪些动作以及做出哪些应答,并对发布请求、执行动作以及返回应答予以解释。这些说明描述了协议的() A.语法 B.语义C.时序 D.异步 【题 1.6】下列不是网络模型进行分层的目标的是() A.提供标准语言 B.定义标准界面

计算机体系结构习题答案解析

第1章计算机系统结构的基本概念 1.1 解释下列术语 层次机构:按照计算机语言从低级到高级的次序,把计算机系统按功能划分成多级层次结构,每一层以一种不同的语言为特征。这些层次依次为:微程序机器级,传统机器语言机器级,汇编语言机器级,高级语言机器级,应用语言机器级等。 虚拟机:用软件实现的机器。 翻译:先用转换程序把高一级机器上的程序转换为低一级机器上等效的程序,然后再在这低一级机器上运行,实现程序的功能。 解释:对于高一级机器上的程序中的每一条语句或指令,都是转去执行低一级机器上的一段等效程序。执行完后,再去高一级机器取下一条语句或指令,再进行解释执行,如此反复,直到解释执行完整个程序。 计算机系统结构:传统机器程序员所看到的计算机属性,即概念性结构与功能特性。 透明性:在计算机技术中,把这种本来存在的事物或属性,但从某种角度看又好像不存在的概念称为透明性。 计算机组成:计算机系统结构的逻辑实现,包含物理机器级中的数据流和控制流的组成以及逻辑设计等。 计算机实现:计算机组成的物理实现,包括处理机、主存等部件的物理结构,器件的集成度和速度,模块、插件、底板的划分与连接,信号传输,电源、冷却及整机装配技术等。 系统加速比:对系统中某部分进行改进时,改进后系统性能提高的倍数。 Amdahl定律:当对一个系统中的某个部件进行改进后,所能获得的整个系统性能的提高,受限于该部件的执行时间占总执行时间的百分比。 程序的局部性原理:程序执行时所访问的存储器地址不是随机分布的,而是相对地簇聚。包括时间局部性和空间局部性。 CPI:每条指令执行的平均时钟周期数。 测试程序套件:由各种不同的真实应用程序构成的一组测试程序,用来测试计算机在各个方面的处理性能。 存储程序计算机:冯·诺依曼结构计算机。其基本点是指令驱动。程序预先存放在计算机存储器中,机器一旦启动,就能按照程序指定的逻辑顺序执行这些程序,自动完成由程序所描述的处理工作。 系列机:由同一厂家生产的具有相同系统结构、但具有不同组成和实现的一系列不同型号的计算机。 软件兼容:一个软件可以不经修改或者只需少量修改就可以由一台计算机移植到另一台计算机上运行。差别只是执行时间的不同。 向上(下)兼容:按某档计算机编制的程序,不加修改就能运行于比它高(低)档的计算机。 向后(前)兼容:按某个时期投入市场的某种型号计算机编制的程序,不加修改地就能

2020.4《计算机体系结构》期末试卷A含答案

《计算机体系结构》期末考试A卷 (总分:100分,时间:100分钟) 姓名:周元华 专业:计算机科学与技术 学号: 18260070164016 学习中心:上海弘成 一、填空题(每空1分,共14分) 1.高速缓冲存储器的地址映象方式有三种,它们分别是:全向量方式,直接相联方式,组相连方式。 2.虚拟存储器的三种管理方式是段式管理,页式管理和 段页式管理。 3.从主存的角度来看,“Cache—主存”层次的目的是为了提高速度,而“主存—辅存”层次的目的是为了扩大容量 4.根据指令间的对同一寄存器读和写操作的先后次序关系,数据相关冲突可分为读与写(RAM)、写与读(WAR)和写与写(WAW)三种类型。 5.当代计算机体系结构的概念包括指令集结构、计算机组成和计算机实现三个方面的内容 二、名词解释(每题2分,共16分) 计算机体系结构: 计算机体系结构是指根据属性和功能不同而划分的计算机理论组成部分及计算机基本工作原理、理论的总称。其中计算机理论组成部分并不单与某一个实际硬件相挂钩,如存储部分就包括寄存器、内存、硬盘等。 兼容机: 兼容机,就是由不同公司厂家生产的具有相同系统结构的计算机。简单点说,就是非厂家原装,而改由个体装配而成的机器,其中的元件可以是同一厂家出品,但更多的是整合各家之长的 计算机。 写直达法: 写直达法一般指全写法。全写法(write-through):又称写直达法、写穿法,透写法,Cache使 用方式之一。 高速缓冲存储器: 高速缓冲存储器(Cache)其原始意义是指存取速度比一般随机存取记忆体(RAM)来得快 的一种RAM,一般而言它不像系统主记忆体那样使用DRAM技术,而使用昂贵但较快速的SRAM 技术,也有快取记忆体的名称。 高速缓冲存储器是存在于主存与CPU之间的一级存储器,由静态存储芯片(SRAM)组成, 容量比较小但速度比主存高得多,接近于CPU的速度。在计算机存储系统的层次结构中,是介 于中央处理器和主存储器之间的高速小容量存储器。它和主存储器一起构成一级的存储器。高速 缓冲存储器和主存储器之间信息的调度和传送是由硬件自动进行的。 高速缓冲存储器最重要的技术指标是它的命中率。 延迟转移技术: 在转移指令之后插入一条或几条有效的指令。当程序执行时,要等这些插入的指令执行完成 之后,才执行转移指令,因此,转移指令好像被延迟执行了,这种技术称为延迟转移技术。 线性流水线: 线性流水线就是由一整套工艺串联而成的生产线。 流水线又称为装配线,一种工业上的生产方式,指每一个生产单位只专注处理某一个片段的工 作,以提高工作效率及产量;按照流水线的输送方式大体可以分为:皮带流水装配线、板链线、 倍速链、插件线、网带线、悬挂线及滚筒流水线这七类流水线。 输送线的传输方式有同步传输的/(强制式),也可以是非同步传输/(柔性式),根据配置的 选择,可以实现装配和输送的要求。输送线在企业的批量生产中不可或缺。 流水线的吞吐率: 流水线的吞吐率是单位时间内流水线处理的任务数。 并行性: 并行性是指计算机系统具有可以同时进行运算或操作的特性,在同一时间完成两种或两种以 上工作。它包括同时性与并发性两种含义。同时性指两个或两个以上事件在同一时刻发生。并发 性指两个或两个以上事件在同一时间间隔发生。 三、简答题(每题5分,共30分) 1.如有一个经解释实现的计算机,可以按功能划分成4级。每一 级为了执行一条指令需要下一级的N条指令解释。若执行第一 级的一条指令需K(ns)时间,那么执行第2、3、4级的一条指 令各需要用多少时间(ns)? 答:第1级:1条1级指令 K ns 第2级:1条2级指令N条1级指令 1*N*K ns = NK ns 第3级:1条3级指令N条2级指令 1*N*NK ns =N2K ns 第4级:1条4级指令N条3级指令 1*N*NNK ns =N3K ns 2.根据Amdahl定律,系统加速比由哪两个因素决定? 答:系统加速比依赖于两个因素: (1)可改进比例:可改进部分在原系统计算时间中所占的比例 (2)部件加速比:可改进部分改进以后的性能提高 3.简述组相联映象规则。 答:(1)主存与缓存分成相同大小的数据块。(2)主存和Cache 按同样大小划分成组。(3)主存容量 是缓存容量的整数倍,将主存空间按缓冲区的大小分成区,主存中每一区的组数与缓存的组数相同 4.引起Cache与主存内容不一致的原因是什么?为了保持Cache 的一致性,在单计算机系统中一般采取哪些措施? 答:不一致的原因:(1)由于CPU写Cache,没有立即写主存 (2)由于I/O处理机或I/O设备写主存 采取措施: (1)全写法,亦称写直达法(WT法-Write through) 方法:在对Cache进行写操作的同时,也对主存该内容进行写入 (2)写回法(WB法-Write back) 方法:在CPU执行写操作时,只写入Cache,不写入主存。 5.按照同一时间内各段之间的连接方式来分,流水线可分为哪两 类? 答:(1)静态流水线:在同一时间内,流水线的各段只能按同一种功能的连接方式工作。 (2)动态流水线:在同一时间内,当某些段正在实现某种运算时,另一些段却在实现另一种运算。 6.Flynn分类法是根据什么对计算机进行分类的?将计算机分 成哪几类? 答:Flynn分类法,根据计算机中指令和数据的并行状况把计算机分成: (1)单指令流单数据流(SISD.; (2)单指令流多数据流(SIMD.; (3)多指令流单数据流(MISD.; (4)多指令流多数据流(MIMD.。 四、问答与计算题(第1题10分,第2、3题每题15分共40分) 1.一个有快表和慢表的页式虚拟存储器,最多有64个用户,每 个用户最多要用1024个页面,每页4K字节,主存容量8M字节。 (1)写出多用户虚地址的格式,并标出各字段的长度。 (2)写出主存地址的格式,并标出各字段的长度。

计算机网络体系结构论文

计算机网络体系结构 摘要:计算机冈络体系结构描述了计算机网络功能实体的划分原则及其相互之间协同工作的方法和规则。本文主要介绍的是现在应用比较广泛的层次型网络体系结构,OSI基本参考模型,计算机网络的七层通信协议的主要功能及其之间的关系,并简单介绍了TCP/IP四层通信模型。 关键字:计算机网络,层次型网络体系结构,OSI,TCP/IP 上世纪60年代末期,早期的网络都是各公司根据用户的要求而设计的。虽然用户的应用要求千变万化,但对网络(通信)的要求相对一致。为使公司的产品可以适应千变万化的应用要求,尤其是适应用户扩充应用的要求,同时也是为了满足市场的要求,保证新老产品的兼容性和可操作性,各公司提出了基于本公司产品的计算机网络体系结构。 随着计算机技术和通信技术的发展,通用的计算机网络体系结构逐渐浮出水面。现在应用比较广泛的网络体系结构为层次型网络体系结构。层次型网络体系结构是计算机网络出现以后第一个被提出并实际使用的网络体系结构。直到目前,其产生和发展的过程始终与计算机网络产生和发展的过程保持协调一致。为了简化网络设计与实现的复杂性,层次型网络体系结构将复杂的网络问题分解为若干个不同的小问题,每个层次专注于解决特定的同题,这样就比较容易对所解决本层次涉及的同题实现模块化和标准化,标准化的层次间的通信规则被称为协议。层次型网络体系结构是层和协议的集合。典型的层次型网络体系结构通信模型如下图所示 层次型网络体系结构首先提出了模块化的设计实现思想:将复杂的网络问题分解为较为单纯易于解决的小问题;用不同的模块解决不同的问题。不同的模块之间接口简单明确,因此可以各自独立地制定标准和进行开发。这一思路即使在后来出现的其他网络体系结构中仍然得到了遵循。 国际标准化组织ISO为层次型网络体系结构设计了OSI参考模型。该模型将网络自底向上划分为物理层、数据链路层、网络层、传输层、会话层、表示层和应用层七个层次,每

计算机体系结构_第一次作业

计算机体系结构 第一章 1.11 Availability is the most important consideration for designing servers, followed closely by scalability and throughput. a. We have a single processor with a failures in time(FIT) of 100. What is the mean time to failure (MTTF) for this system? b. If it takes 1 day to get the system running again, what is the availability of the system? c. Imagine that the government, to cut costs, is going to build a supercomputer out of inexpensive computers rather than expensive, reliable computers. What is the MTTF for a system with 1000 processors? Assume that if one fails, they all fail. 答: a. 平均故障时间(MTTF)是一个可靠性度量方法,MTTF的倒数是故 障率,一般以每10亿小时运行中的故障时间计算(FIT)。因此由该定义可知1/MTTF=FIT/10^9,所以MTTF=10^9/100=10^7。b. 系统可用性=MTTF/(MTTF+MTTR),其中MTTR为平均修复时间, 在该题目中表示为系统重启时间。计算10^7/(10^7+24)约等于1. c. 由于一个处理器发生故障,其他处理器也不能使用,所以故障率 为原来的1000倍,所以MTTF值为单个处理器MTTF的1/1000即10^7/1000=10^4。 1.14 In this exercise, assume that we are considering enhancing

计算机体系结构期末试卷及答案

课程测试试题( A 卷) ----------------------以下为教师填写-------------------- I、命题院(部):信息科学与工程学院 II、课程名称:计算机体系结构 III、测试学期:2014-2015学年度第2学期 IV、测试对象:信息学院计算机、网络专业 2012 级班 V、问卷页数(A4): 3 页 VI、答卷页数(A4): 4 页 VII、考试方式:闭卷(开卷、闭卷或课程小论文,请填写清楚) VIII、问卷内容: 一、填空题(共30分,20空,每空分) 1、现代计算机系统是由()和()组成的十分复杂的系统。 2、计算机系统应能支持软件可移植,实现可移植性的常用方法有3种,即(),(), 统一高级语言。 3、可以将当前大多数通用寄存器型指令集结构进一步细分为3种类型,即()、() 和存储器-存储器型指令集结构。 4、MIPS指令DADDIU R14,R5,#6属于()类型的指令格式;MIPS指令 SD R4,300(R5)属于()类型的指令格式。 5、描述流水线的工作,常采用时空图的方法。在时空图中,横坐标表示(),纵坐 标代表()。 6、在MIPS指令实现的简单数据通路中,在WB周期中,有两大类指令执行操作:() 和()指令。 7、存储器的层次结构中,“Cache-主存”层次是为了弥补主存()的不足,“主 存-辅存”层次是为了弥补主存()的不足。 8、Cache实现的映像规则有全相联映像、()和()三种。 9、反映存储外设可靠性能的参数有可靠性、()和()。 10、根据系统中处理器个数的多少,可把现有的MIMD计算机分为两类,每一类代表 了一种存储器的结构和互连策略。第一类机器称为()结构,第二类机器具有()。 二、判断题(每小题1分,共10分) 1、从计算机语言的角度,系统结构把计算机系统按功能划分成多级层次结构,其中, 第2级是操作系统虚拟机,第3级是汇编语言虚拟机。() 2、计算机系统中提高并行性的3种途径中,资源重复是在并行性概念中引入时间因 素,加快硬件周转而赢得时间。() 3、指令集结构中采用多种寻址方式可能会增加实现的复杂度和使用这些寻址方式的 指令的CPI。() 4、指令条数多,通常超过200条,是设计RISC的原则之一。() 5、根据流水线中各功能段之间是否有反馈回路,可把流水线分为线性流水线和非线 性流水线。() 6、在多级存储体系中,“cache——主存”层次的存储管理实现主要由软件件实现。

- 计算机系统结构知识点

- 计算机体系结构知识点汇总

- 计算机体系结构期末考试知识点与答案

- 微型计算机原理与应用知识点总结

- 计算机体系结构知识点汇总

- 高级计算机体系结构知识点

- 计算机体系结构期末考试知识点与答案

- 计算机体系结构知识点

- 高级计算机系统结构部分知识点整理

- 最新计算机组成原理知识点总结

- 计算机系统结构_知识点总结

- 计算机体系结构知识点汇总

- 事业单位计算机专业技术知识点归纳

- 计算机体系结构期末考试知识点与答案

- 高级计算机体系结构知识点汇编

- 计算机体系结构期末考试知识点与答案复习过程

- 高级计算机体系结构知识点汇总

- 计算机体系结构知识点汇总

- 计算机系统结构期末知识点总结

- 计算机系统结构期末知识点总结