USB音频解码IC

USB声卡和USB音频解码方案原理

近年来USB产品层出不穷,USB音频类在USB开发者论坛的努力下,成为一种标准的规范,USB声卡也开始在市场上悄然出现。因为USB声卡内置了DAC和有源功放,音频数据以数字方式进入USB声卡,完全杜绝了PC的内部干扰,所以,USB声卡将有可能成为现有内置声卡的替代品。本文介绍了一种基于ARM处理器的USB声卡设计。

USB声卡原理

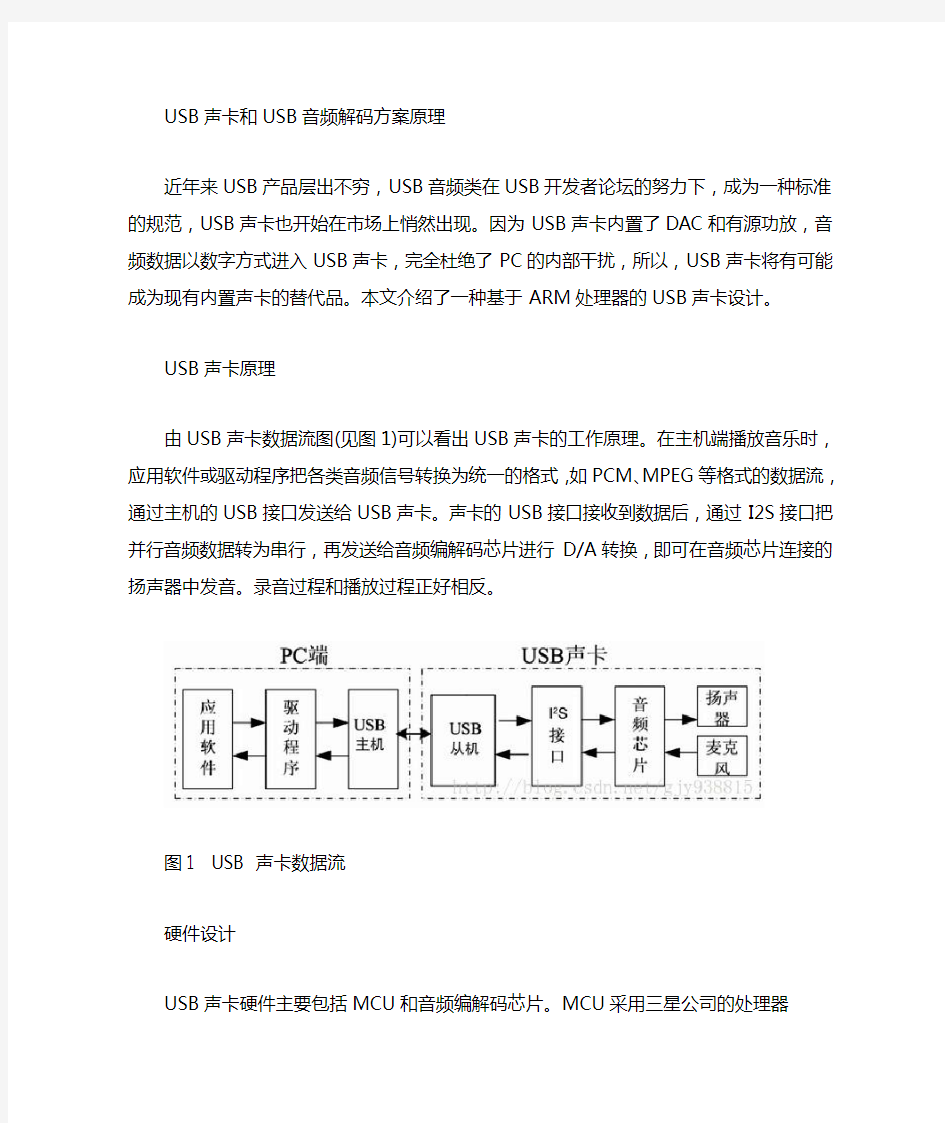

由USB声卡数据流图(见图1)可以看出USB声卡的工作原理。在主机端播放音乐时,应用软件或驱动程序把各类音频信号转换为统一的格式,如PCM、MPEG等格式的数据流,通过主机的USB接口发送给USB声卡。声卡的USB 接口接收到数据后,通过I2S接口把并行音频数据转为串行,再发送给音频编解码芯片进行D/A转换,即可在音频芯片连接的扬声器中发音。录音过程和播放过程正好相反。

图1 USB 声卡数据流

硬件设计

USB声卡硬件主要包括MCU和音频编解码芯片。MCU采用三星公司的处理器S3C2410,S3C2410内置I2S总线控制器和USB Slaver控制器。S3C2410的I2S控制器实现了一个外部8/16位立体声音频CODEC IC的接口,支持I2S 总线数据格式和MSB-justified数据格式,并且支持DMA传输模式。

音频芯片采用UDA1341TS。UDA1341TS提供标准的I2S接口,可以直接和SSS1630的I2S引脚连接。另外,此芯片还提供标准的L3、麦克风和扬声器接口。L3接口的引脚分别连到S3C2410的3个GPIO输出引脚上,通过GPIO 控制L3接口。UDA1341TS音频芯片集成数字化音频和混频器功能。数字化音频功能可以播放数字化声音或录制声音,因为包括这个功能,所以常把此类芯片称为CODEC设备。混频器用来控制各种输入/输出的音量大小等,在本芯片中通过L3接口进行控制。

图2 USB声卡拓扑图

软件设计

软件设计包括两部分:USB声卡固件程序设计和主机端Windows驱动设计。因为USB音频类设备是一种标准设备,在Windows 操作系统上有标准的USB 音频驱动,所以只需要开发者根据USB音频类的协议开发固件程序。

USB声卡的固件程序主要包括两部分,第一部分主要是USB通讯,第二部分实现I2S接口数据传输以及数据流的缓冲区控制等。

USB声卡的控制传输

在主机端应用程序中,执行音量调节、静音等事件时,USB音频驱动通过默认端点0执行一个控制传输。一次控制传输主要包括两个步骤,第一步,由主机向设备发送一个建立(Setup)信息,描述控制访问的类型,设备将执行此控制访问。第二步,零个或多个控制数据信息的传送,这是访问的具体信息。根据USB 音频类协议分解控制信息包,然后再根据控制信息,执行相应的操作。例如,在主机端应用程序中播放音乐前,USB声卡就会从主机端收到如下的两个包:Setup包22 01 00 01 01 00 03 00

控制数据包40 1F 00

根据USB音频类协议分解Setup包,可以得知,本次控制传输的作用是设置USB声卡的采样频率,并且收到的3字节控制数据信息是采样频率,即8KHz。那么在播放音乐前,必须把I2S和SSS1630芯片的采样频率设置为96kHz,才能和主机端保持同步。

SSS1629和SSS1630主要应用产品如下:

USB游戏耳机方案,USB麦克风方案,USB音响方案,USB话务耳机方案,K歌方案,智能语音家居方案等等。

音频的编解码

音频编码解码基本概念介绍 对数字音频信息的压缩主要是依据音频信息自身的相关性以及人耳对音频信息的听觉冗余度。音频信息在编码技术中通常分成两类来处理,分别是语音和音乐,各自采用的技术有差异。 语音编码技术又分为三类:波形编码、参数编码以及混合编码。 波形编码:波形编码是在时域上进行处理,力图使重建的语音波形保持原始语音信号的形状,它将语音信号作为一般的波形信号来处理,具有适应能力强、话音质量好等优点,缺点是压缩比偏低。该类编码的技术主要有非线性量化技术、时域自适应差分编码和量化技术。非线性量化技术利用语音信号小幅度出现的概率大而大幅度出现的概率小的特点,通过为小信号分配小的量化阶,为大信号分配大的量阶来减少总量化误差。我们最常用的G.711标准用的就是这个技术。自适应差分编码是利用过去的语音来预测当前的语音,只对它们的差进行编码,从而大大减少了编码数据的动态范围,节省了码率。自适应量化技术是根据量化数据的动态范围来动态调整量阶,使得量阶与量化数据相匹配。G.726标准中应用了这两项技术,G.722标准把语音分成高低两个子带,然后在每个子带中分别应用这两项技术。 参数编码:广泛应用于军事领域。利用语音信息产生的数学模型,提取语音信号的特征参量,并按照模型参数重构音频信号。它只能收敛到模型约束的最好质量上,力图使重建语音信号具有尽可能高的可懂性,而重建信号的波形与原始语音信号的波形相比可能会有相当大的差别。这种编码技术的优点是压缩比高,但重建音频信号的质量较差,自然度低,适用于窄带信道的语音通讯,如军事通讯、航空通讯等。美国的军方标准LPC-10,就是从语音信号中提取出来反射系数、增益、基音周期、清/浊音标志等参数进行编码的。MPEG-4标准中的HVXC声码器用的也是参数编码技术,当它在无声信号片段时,激励信号与在CELP时相似,都是通过一个码本索引和通过幅度信息描述;在发声信号片段时则应用了谐波综合,它是将基音和谐音的正弦振荡按照传输的基频进行综合。 混合编码:将上述两种编码方法结合起来,采用混合编码的方法,可以在较低的数码率上得到较高的音质。它的特点是它工作在非常低的比特率(4~16 kbps)。混合编码器采用合成分析技术。

实验13、CoolEdit数字音频处理剖析

实验13、CoolEdit数字音频处理 实验课时: 课内:2课时;课外:1课时 实验目的: 了解音频数据的特性及其获取和处理的方法,学会使用音频编辑工具CoolEdit进行音频数据的录制、编辑和播放 实验内容: 操作准备 1.在D:或E:分区创建一个以你的“完整学号+姓名”命名的文件夹(名称应类似: 198009010001文立斌),我们把这个文件夹简称为“你的文件夹” 2.以下操作步骤中所涉及的198009010001、文立斌均应替换成你的学号、姓名 3.准备好音频实验环境,个别人物需要准备麦克风、音箱(或耳机) 任务一、音频提取 1.打开CoolEditPro软件 2.如下图所示,单击工具栏最左边的按钮切换到波形编辑界面 → 3.依次执行菜单命令【文件】→【从视频文件中提取】,通过系统显示的“选择视频文件” 对话框选定“说唱脸谱.dat”文件后单击【打开】按钮,系统开始从“说唱脸谱.dat” 中提取音频 4.等待系统提取音频结束后,执行菜单命令【文件】→【另存为】,将提取到的波形保存 为类似“文立斌A.wma”(.wma格式)的文件 任务二、淡入淡出 1.打开CoolEditPro软件 2.如下图所示,单击工具栏最左边的按钮切换到波形编辑界面 → 3.依次执行菜单命令【文件】→【打开】,通过系统显示的“打开波形文件”对话框选定 “最炫民族风.mp3”文件后单击【打开】按钮打开该文件,原始波形编辑面板类似:

4.单击视窗左下角录播工具面板中的播放按钮,试听歌曲,确定演唱(人声)从何时(第 几秒)开始——大约是第23秒! 5.如下图所示,在波形编辑面板中以鼠标拖拽的方式选定最前面23秒波形: 如果需要精确选定波形区域,您还可以借助视窗右下角的如下面板,直接输入始末时间: 6.依次执行菜单命令【效果】→【波形振幅】→【渐变】,如下图所示,在“波形振幅” 对话框中,选择“Fade in”(淡入),然后单击【确定】按钮: 7.系统进行淡入处理后的波形类似: 您应该对照一下处理前后的前23秒波形的异同 8.试听,您应该能听到淡入处理的效果(音量越来越大)才对! 9.从4分20秒位置开始选定直到音频结束处的波形,为选定的波形添加淡出效果,处理 第2页

数字音频处理器中文使用说明

MAXIDRIVER3.4数字音频处理器 ALTO MAXIDRIVER3.4数字处理器是集增益、噪声门、参数均衡、分频、压缩限 幅、延时为一体的全功能数字音频处理器,具有2个输入通道和6个输出通道,本机内设10种工厂预设的分频模式,64个用户程序数据库位置以及利用多媒体卡(MMC)进行128个用户程序外置储存的功能。MAXIDRIVER3.4是新一代全数字音 频处理器,采用分级菜单形式,操作非常方便。 功能键介绍 前面板 1、MODE---分级菜单选择,按动时循环选择PRESET(预设)、DELAY(延时)、EDIT(编辑)、UTILITY(系统设置)菜单功能。同时相对应的LED指示灯会被点亮。这时可以进入所选择的菜单进行参数编辑。 2、LED指示灯---当你用MODE键选择需要编辑的菜单时,相对应的LED指示 灯会被点亮。 3、2X16位LCD显示屏---显示正在编辑或查看的系统参数或系统状态。 4、数据轮---转动这个数据轮可以调节需要编辑的参数的数值,顺时针旋转提高数值,逆时针旋转减低数值。 5、PREV/NEXT---前翻/后翻键,每个主菜单下面都有若干个子菜单,通过按动这两个按键可以向前或向后选择所需要进行编辑的子菜单。 6、NAVIGATION CURSOR KEYS---光标移动键,每个子菜单中都有若干个可以 编辑的参数选择,按动这两个键,可以选择需要编辑的参数,选中的参数会闪烁。 7、CARD---储存卡插入口,在这个插口插入MMC储存卡,利用PRESET(预设) 菜单下,可以对该储存卡进行写入、读出等操作。 8、ENTER---确认键,按此键可以对所选择的菜单或编辑的参数数值进行确认。 9、ESC---取消键,按此键可以对所选择的菜单或编辑的参数数值进行取消操作,返回上一级菜单。 10、输入电平指示表,实时指示A/B两个输入通道输入电平的强弱数值。 11、MUTE---静音按键,按下后将关闭相应输出通道的输出信号,相对应的 红色LED指示灯将点亮。 12、输出电平指示表,显示每个输出通道输出电平大小数值,这里显示的数 值不是绝对的输出电平数值,而是与该列LED指示灯中的LIMIT(限幅)指示为基础相比较的数值。

数字音视频处理

实验报告 课程名称数字音视频原理 实验题目MATLAB音频文件处理 专业电子信息工程 班级3班 学号09080323 学生姓名王志愿 实验成绩 指导教师吴娱 2012年3月 一、实验目的 1、掌握录制语音信号的基本过程; 2、掌握MATLAB编程对语音信号进行简单处理的方法并分析结果。 二、实验要求

上机完成实验题目,独立完成实验报告。 三、实验内容 1、问题的提出:数字语音是信号的一种,我们处理数字语音信号,也就是对一种信号的处理,那信号是什么呢? 信号是传递信息的函数。离散时间信号(序列)——可以用图形来表示。 按信号特点的不同,信号可表示成一个或几个独立变量的函数。例如,图像信号就是空间位置(二元变量)的亮度函数。一维变量可以是时间,也可以是其他参量,习惯上将其看成时间。信号有以下几种: (1)连续时间信号:在连续时间范围内定义的信号,但信号的幅值可以是连续数值,也可以是离散数值。当幅值为连续这一特点情况下又常称为模拟信号。实际上连续时间信号与模拟信号常常通用,用以说明同一信号。 (2)离散时间信号:时间为离散变量的信号,即独立变量时间被量化了。而幅度仍是连续变化的。 (3)数字信号:时间离散而幅度量化的信号。 语音信号是基于时间轴上的一维数字信号,在这里主要是对语音信号进行频域上的分析。在信号分析中,频域往往包含了更多的信息。对于频域来说,大概有8种波形可以让我们分析:矩形方波,锯齿波,梯形波,临界阻尼指数脉冲波形,三角波,余弦波,余弦平方波,高斯波。对于各种波形,我们都可以用一种方法来分析,就是傅立叶变换:将时域的波形转化到频域来分析。 2、设计方案: 首先要对声音信号进行采集,Windows自带的录音机程序可驱动声卡来采集语音信号,并能保存成.WAV格式文件,供MATLAB相关函数直接读取、写入或播放。 利用MATLAB中的wavread命令来读入(采集)语音信号,将它赋值给某一向量。再将该向量看作一个普通的信号,对其进行FFT变换实现频谱分析,再依据实际情况对它进行滤波。对于波形图与频谱图(包括滤波前后的对比图)都可以用MATLAB画出。我们还可以通过sound/wavplay命令来对语音信号进行回放,以便在听觉上来感受声音的变化。 3、主体部分: (1)语音的录入与打开: [x,fs,bits]=wavread('d:\1.wav');%用于读取语音,采样值放在向量x中,fs 表示采样频率(Hz),bits表示量化位数。

BIAMP Nexia CS数字音频处理器

BIAMP Nexia CS数字音频处理器 [会议系统]适用于需要大量话筒的应用环境,诸如法庭,会议室,理事会等场合。 Nexia CS是一台数字信号处理器,配有10路话筒/线路输入和6路独立的混合输出,可满足会议室、法庭和理事会等场合的会议应用。Nexia的设计软件中提供了大量的路由选择、信号处理等模块,用户可以通过PC软件来对系统进行搭积木式的设计。通过控制软件的屏幕、RS-232接口或者其他兼容的遥控设备可以对Nexia CS进行控制。利用以太网和NexLink数字音频接口,多台Nexia 设备可以联机构成大系统工作。 特性: 10路平衡式话筒/线路输入,采用裸线接口端子。 6路平衡式输出,采用裸线接口端子。 以太网接口用于软件设置/控制。 串行接口用于第三方RS-232远程控制。 远程控制母线用于特制的控制面板。 NexLink接口用于多台设备联机工作。 NEXIA软件,可工作在WindowsNT4.0/2000/XP。 固定数量的输入输出接口,内部处理可自由设定。 具有混合、线路交换、组合、均衡、延时、控制等多种功能。 CE认证标志,通过CSA UL6500标准测试。 设计师和工程师用指标说明 数字会议系统应该具备10路配有裸线接口端子的平衡式话筒/线路输入和6路配有裸线接口端子的平衡式线路输出。输入输出都是模拟信号,设备内部采用24-bit量化、48kHz取样频率进行模拟/数字和数字/模拟转换。所有的内部处理都是数字处理。采用NexLink连接后,允许在多台设备间共享数字音频信

号。 可以用软件来创建或者连接每一台硬件设备中数字信号处理组件。可选用的系统组件应该包括(并不限定于):调音台、均衡器、分频器、动态增益控制器,路由选择、延时器、远程控制器、电平表、信号发生器以及诊断器。软件设置和控制可通过以太网连接进行操作。设定完成之后,处理器可以通过软件显示屏进行控制。第三方RS-232控制系统和第三方遥控设备都可以用来控制本设备。软件可以在一台工作在Windows NT4.0/2000/XP下,配有网卡的个人电脑下运行。 Nexia CS就是满足以上要求的数字会议系统。 各模块界面: (1)输入/输出模块界面 输入/输出10进6出界面 (2)其它模块界面与Nexia SP相同。

(完整)流媒体传输协议及音视频编解码技术

1.1音视频编解码技术 1.1.1 MPEG4 MPEG全称是Moving Pictures Experts Group,它是“动态图象专家组”的英文缩写,该专家组成立于1988年,致力于运动图像及其伴音的压缩编码标准化工作,原先他们打算开发MPEG1、MPEG2、MPEG3和MPEG4四个版本,以适用于不同带宽和数字影像质量的要求。 目前,MPEG1技术被广泛的应用于VCD,而MPEG2标准则用于广播电视和DVD等。MPEG3最初是为HDTV开发的编码和压缩标准,但由于MPEG2的出色性能表现,MPEG3只能是死于襁褓了。MPEG4于1999年初正式成为国际标准。它是一个适用于低传输速率应用的方案。与MPEG1和MPEG2相比,MPEG4更加注重多媒体系统的交互性和灵活性MPEG1、MPEG2技术当初制定时,它们定位的标准均为高层媒体表示与结构,但随着计算机软件及网络技术的快速发展,MPEG1、MPEG2技术的弊端就显示出来了:交互性及灵活性较低,压缩的多媒体文件体积过于庞大,难以实现网络的实时传播。而MPEG4技术的标准是对运动图像中的内容进行编码,其具体的编码对象就是图像中的音频和视频,术语称为“AV对象”,而连续的AV对象组合在一起又可以形成AV场景。因此,MPEG4标准就是围绕着AV对象的编码、存储、传输和组合而制定的,高效率地编码、组织、存储、传输AV 对象是MPEG4标准的基本内容。 在视频编码方面,MPEG4支持对自然和合成的视觉对象的编码。(合成的视觉对象包括2D、3D动画和人面部表情动画等)。在音频编码上,MPEG4可以在一组编码工具支持下,对语音、音乐等自然声音对象和具有回响、空间方位感的合成声音对象进行音频编码。 由于MPEG4只处理图像帧与帧之间有差异的元素,而舍弃相同的元素,因此大大减少了合成多媒体文件的体积。应用MPEG4技术的影音文件最显著特点就是压缩率高且成像清晰,一般来说,一小时的影像可以被压缩为350M左右的数据,而一部高清晰度的DVD电影, 可以压缩成两张甚至一张650M CD光碟来存储。对广大的“平民”计算机用户来说,这就意味着, 您不需要购置DVD-ROM就可以欣赏近似DVD质量的高品质影像。而且采用MPEG4编码技术的影片,对机器硬件配置的要求非常之低,300MHZ 以上CPU,64M的内存和一个8M显存的显卡就可以流畅的播放。在播放软件方面,它要求也非常宽松,你只需要安装一个500K左右的MPEG4 编码驱动后,用WINDOWS 自带的媒体播放器就可以流畅的播放了 AV对象(AVO,Audio Visual Object)是MPEG-4为支持基于内容编码而提出的重要概念。对象是指在一个场景中能够访问和操纵的实体,对象的划分可根据其独特的纹理、运动、形状、模型和高层语义为依据。在MPEG-4中所见的音视频已不再是过去MPEG-1、MPEG-2中图像帧的概念,而是一个个视听场景(AV场景),这些不同的AV场景由不同的AV对象组成。AV对象是听觉、视觉、或者视听内容的表示单元,其基本单位是原始AV对象,它可以是自然的或合成的声音、图像。原始AV对象具有高效编码、高效存储与传输以及可交互性的特性,它又可进一步组成复合AV对象。因此MPEG-4标准的基本内容就是对AV对象进行高效编码、组织、存储与传输。AV对象的提出,使多媒体通信具有高度交互及高效编码的能力,AV对象编码就是MPEG-4的核心编码技术。 MPEG-4不仅可提供高压缩率,同时也可实现更好的多媒体内容互动性及全方位的存取性,它采用开放的编码系统,可随时加入新的编码算法模块,同时也可根据不同应用需求现场配置解码器,以支持多种多媒体应用 1.1.2 H264 H.264是由ITU-T的VCEG(视频编码专家组)和ISO/IEC的MPEG(活动图像编码专家组)联合组建的联合视频组(JVT:joint video team)提出的一个新的数字视频编码标准,

教你怎样使用数字音频处理器

怎样使用数字音频处理器现在数字音频处理器越来越多地运用到工程当中了,对于有基础有经验的人来说,处理器是一个很好用的工具,但是,对于一些经验比较欠缺的朋友来说,看着一台处理器,又是一大堆英文,不免有点无从下手。其实不用慌,我来介绍一下处理器使用步骤,以一个2进4出的处理器控制全频音箱+超低音音箱的系统为例 1、首先是用处理器连接系统,先确定好哪个输出通道用来控制全频音箱,哪个输出通道用来控制超低音音箱,比如你用输出1、2通道控制超低音,用输出3、4通道控制全频。接好线了,就首先进入处理器的编辑(EDIT)界面来进行设置,进入编辑界面不同的产品的方法不同,具体怎么进入,去看说明书。 2、利用处理器的路由(ROUNT)功能来确定输出通道的信号来自哪个输入通道,比如你用立体声方式扩声形式,你可以选择输出通道1、3的信号来自输入A,输出通道的2、4的信号来自输入B。信号分配功能不同的产品所处的位置不同,有些是在分频模块里,有些是在增益控制模块里,这个根据说明书的指示去找。 3、根据音箱的技术特性或实际要求来对音箱的工作频段进行设置,也就是设置分频点。处理器上的分频模块一般用CROSSOVER或X-OVER表示,进入后有下限频率选择(HPF)和上限频率选择(LPF),还要滤波器模式和斜率的选择。首先先确定工作频段,比如超低音的频段是40-120赫兹,你就把超低音通道的HPF设置为40,LPF设置为120。全频音箱如果你要控制下限,就根据它的低音单元口径,设置它的HPF大约在50-100Hz,。处理器滤波器形式选择一般有三种,bessel,butterworth和linky-raily,我以前有帖子专门说明过三种滤波器的不同之处,这里不赘述。常用的是butterworth和linky-raily两种,然后是分频斜率的选择,一般你选24dB/oct就可以满足大部分的用途了。 4、这个时候你需要检查一下每个通道的初始电平是不是都在0dB位置,如果有不是0的,先把它们都调到0位置上,这个电平控制一般在GAIN功能里,DBX的处理器电平是在分频器里面的,用G表示。 5、现在就可以接通信号让系统先发出声音了,然后用极性相位仪检查一下音箱的极性是否统一,有不统一的,先检查一下线路有没有接反。如果线路没接反,而全频音箱和超低音的极性相反了,可以利用处理器输出通道的极性翻转功能(polarity或pol)把信号的极性反转,一般用Nomal或“+”表示正极性,用INV或“-”表示负极性。 6、接下来就要借助SIA这类工具测量一下全频音箱和超低音的传输时间,一般来说是会有差异的,比如测到全频的传输时间是10ms,超低音是18ms,这个时候就要利用处理器的延时功能对全频进行延时,让全频和低音的传输时间相同。处理器的延时用DELAY或DLY表示,有些用m(米)有些用MS(毫秒)来显示延时量,SIA软件也同时提供了时间和距离的量,你可以选择你需要的数据值来进行延时 7、接下来就该进行均衡的调节了,可以配合测试工具也可以用耳朵来调,处理器的均衡用EQ来表示,一般都是参量均衡(PEQ),参量均衡有3个调节量,频率(F),带宽(Q 或OCT),增益(GAIN或G)。具体怎么调,就根据产品特性、房间特性和主观听觉来调了,这个就自己去想了。 8、均衡调好后,就要进行限幅器的设置了,处理器的限幅器用LIMIT来表示,进去以后一般有限幅电平(THRESHOLD),压缩比(RA TIO)的选项,你要做限幅就要先把压缩比RA TIO设置为无穷大(INF),然后配合功放来设置限幅电平,变成限幅器后,启动时间A TTACK和恢复时间RELEASE就不用去理了。DBX处理器的限幅器用PEAKSTOP来表示,启动后,直接设置限幅电平就可以了,至于怎么调限幅器,我有专门的帖子,自己去看。 9、都调好了就要保存数据,处理器的保存一般用STORE或SA VE表示,怎么存,就看产品说明书了。

各种音视频编解码学习详解 h264

各种音视频编解码学习详解h264 ,mpeg4 ,aac 等所有音视频格式 编解码学习笔记(一):基本概念 媒体业务是网络的主要业务之间。尤其移动互联网业务的兴起,在运营商和应用开发商中,媒体业务份量极重,其中媒体的编解码服务涉及需求分析、应用开发、释放license收费等等。最近因为项目的关系,需要理清媒体的codec,比较搞的是,在豆丁网上看运营商的规范标准,同一运营商同样的业务在不同文档中不同的要求,而且有些要求就我看来应当是历史的延续,也就是现在已经很少采用了。所以豆丁上看不出所以然,从wiki上查。中文的wiki信息量有限,很短,而wiki的英文内容内多,删减版也减肥得太过。我在网上还看到一个山寨的中文wiki,长得很像,红色的,叫―天下维客‖。wiki的中文还是很不错的,但是阅读后建议再阅读英文。 我对媒体codec做了一些整理和总结,资料来源于wiki,小部分来源于网络博客的收集。网友资料我们将给出来源。如果资料已经转手几趟就没办法,雁过留声,我们只能给出某个轨迹。 基本概念 编解码 编解码器(codec)指的是一个能够对一个信号或者一个数据流进行变换的设备或者程序。这里指的变换既包括将信号或者数据流进行编码(通常是为了传输、存储或者加密)或者提取得到一个编码流的操作,也包括为了观察或者处理从这个编码流中恢复适合观察或操作的形式的操作。编解码器经常用在视频会议和流媒体等应用中。 容器 很多多媒体数据流需要同时包含音频数据和视频数据,这时通常会加入一些用于音频和视频数据同步的元数据,例如字幕。这三种数据流可能会被不同的程序,进程或者硬件处理,但是当它们传输或者存储的时候,这三种数据通常是被封装在一起的。通常这种封装是通过视频文件格式来实现的,例如常见的*.mpg, *.avi, *.mov, *.mp4, *.rm, *.ogg or *.tta. 这些格式中有些只能使用某些编解码器,而更多可以以容器的方式使用各种编解码器。 FourCC全称Four-Character Codes,是由4个字符(4 bytes)组成,是一种独立标示视频数据流格式的四字节,在wav、a vi档案之中会有一段FourCC来描述这个AVI档案,是利用何种codec来编码的。因此wav、avi大量存在等于―IDP3‖的FourCC。 视频是现在电脑中多媒体系统中的重要一环。为了适应储存视频的需要,人们设定了不同的视频文件格式来把视频和音频放在一个文件中,以方便同时回放。视频档实际上都是一个容器里面包裹着不同的轨道,使用的容器的格式关系到视频档的可扩展性。 参数介绍 采样率 采样率(也称为采样速度或者采样频率)定义了每秒从连续信号中提取并组成离散信号的采样个数,它用赫兹(Hz)来表示。采样频率的倒数叫作采样周期或采样时间,它是采样之间的时间间隔。注意不要将采样率与比特率(bit rate,亦称―位速率‖)相混淆。

音频编解码介绍

音频编解码原理介绍 一.为什么要进行音频编解码 二.音频编解码原理 三.几种基本音频编解码介绍 一、为什么要进行音频编解码 随着人们对多媒体图像和声音的要求越来越高,在高清晰数字电视(HDTV)和数字电影中不仅应有高质量的图像,也应当具有CD质量的立体声。因为用数字方法记录声音比用模拟方法记录声音具有更强的优势,例如传输时抗噪声能力强、增加音频动态范围、多次翻录没有信号衰减等。但是数字声音最大的缺陷是记录的数据量大,表现在两个方面:其一是在传输过程中,传输数字声音需要占用很宽的传输带宽;其二是在存储过程中,需要占用大量的存储空间。所以在数字音频中需要采用数字音频压缩技术,对音频数据进行压缩。 二、音频编解码原理 每张CD光盘重放双声道立体声信号可达74分钟。VCD视盘机要同时重放声音和图像,图像信号数据需要压缩,其伴音信号数据也要压缩,否则伴音信号难于存储到VCD光盘中。 一、伴音压缩编码原理 伴音信号的结构较图像信号简单一些。伴音信号的压缩方法与图像信号压缩技术有相似性,也要从伴音信号中剔除冗余信息。人耳朵对音频信号的听觉灵敏度有规律性,对于不同频段或不同声压级的伴音有其特殊的敏感特性。在伴音数据压缩过程中,主要应用了听觉阈值及掩蔽效应等听觉心理特性。 1、阈值和掩蔽效应 (1) 阈值特性 人耳朵对不同频率的声音具有不同的听觉灵敏度,对低频段(例如100Hz以下)和超高频段(例如16KHZ以上)的听觉灵敏度较低,而在1K-5KHZ的中音频段时,听觉灵敏度明显提高。通常,将这种现象称为人耳的阈值特性。若将这种听觉特性用曲线表示出来,就称为人耳的阈值特性曲线,阈值特性曲线反映该特性的数值界限。将曲线界限以下的声音舍弃掉,对人耳的实际听音效果没有影响,这些声音属于冗余信息。 在伴音压缩编码过程中,应当将阈值曲线以上的可听频段的声音信号保留住,它是可听频段的主要成分,而那些听觉不灵敏的频段信号不易被察觉。应当保留强大的信号,忽略舍弃弱小的信号。经过这样处理的声音,人耳在听觉上几乎察觉不到其失真。在实际伴音压缩编码过程中,也要对不同频段的声音数据进行量化处理。可对人耳不敏感频段采用较粗的量化步长进行量化,可舍弃一些次要信息;而对人耳敏感频段则采用较细小的量化步长,使用较多的码位来传送。 (2)掩蔽效应 掩蔽效应是人耳的另一个重要生理特征。如果在一段较窄的频段上存在两种声音信号,当一个强度大于另一个时,则人耳的听觉阈值将提高,人耳朵可以听到大音量的声音信号,而其附近频率小音量的声音信号却听不到,好像是小音量信号被大音量信号掩蔽掉了。由于其它声音信号存在而听不到本声音存在的现象,称为掩蔽效应。 根据人耳的掩蔽特性,可将大音量附近的小音量信号舍弃掉,对实际听音效果不会发生影响。既使保留这些小音量信号,人耳也听不到它们的存在,它属于伴音信号中的冗余信息。舍弃掉这些信号,可以进一步压缩伴音数据总量。

数字音视频编解码技术标准工作组知识产权政策

数字音视频编解码技术标准工作组知识产权政策

————————————————————————————————作者:————————————————————————————————日期:

数字音视频编解码技术标准工作组知识产权政策 (2004年9月12日第十次工作会议通过实施) (2008年3月29日第二十四次工作会议修订) 第一章、总则 第一条本知识产权政策文件(“知识产权政策”)规定了中国数字音视频编解码技术标准工作组(“工作组”)的与制订A VS技术标准的整个过程及其所产生的标准文 档相关的知识产权的管理规则。 第二条通过签署A VS会员协议,会员书面承诺该会员及其关联者及其工作组成员同意并遵守本知识产权政策的条款。 第三条本知识产权政策是A VS会员协议的必要组成部分,并通过引用纳入会员协议。 第二章、定义 第四条对于在本知识产权政策中使用并且在A VS章程、A VS会员协议和A VS章程细则中已有定义的词语,其含义应遵从有关文件中的定义。以下词语在本知识产 权政策中定义为以下含义: 1、“符合部分”仅指有关产品或服务中实施并符合最终A VS 标准的所有相关规范性要求的特定部分,这些规范性要求应当 在最终A VS标准中明确公开,并且其目的是为了使产品或服 务能够实现该最终AVS标准所定义的解码、编码、发送数字 媒体或识别和实施权利管理。 2、“必要权利要求”是指根据授权或公布专利的所在国法律, 被最终A VS标准的符合部分不可避免地侵权的该专利中的某 一权利要求,且仅限于该权利要求。 专利的某一权利要求被不可避免地侵权,是指该侵权不可能在 实施最终A VS标准时通过采用另一个技术上可行的不侵权的 实施方式予以避免。 必要权利要求不包括,并且许可也不适用于:(1)不符合上文 规定的其他权利要求,即使该权利要求包含在同一件专利中; (2)在最终的A VS标准文档中引用或以参考方式包括在内的 其他标准中涉及的权利要求;(3)制造或使用符合最终AVS 标准文档的任何产品、服务及其部分时可能必要,但没有明确 地在该标准文档中描述的实现技术。 3、“专利”是指许可方或其关联者拥有的或者在无需向非关联 第三方付费的情况下有权许可的,在任何国家授权的任何专 利、可执行的发明证书、授权的实用新型、或公布提请异议的 任何可执行的专利申请或实用新型申请,但不包括外观设计专 利和外观设计登记。 4、“规范性参考文件”是指并非由工作组制定而是通过引用包

音频剪辑软件哪个好用呢

现在网络上充斥着各种配音视频或者是修改音效的视频。B站里面的鬼畜视频几乎都是魔改音效的视频。当然这些视频都是使用视频剪辑软件和音频剪辑软件一起制作的。可以在视频中进行视频剪切、视频合并、视频分割去制作新的视频。当然音频也可以通过音频合并、音频分割和音频提取制作新的声音。那么下面就是使用音频剪辑软件制作声音的教程了。 1、首先还是需要安装一款音频编辑软件的。在迅捷视频官网中把迅捷音频转换器下载到桌面上,然后就是打开安装程序选择软件的安装保存位置,然后点击立即安装就可以了。 2、然后在软件中选择音频提取,由于软件默认使用音频转换功能,所以在开始使用之前也是需要提前修改文件格式的。然后点击软件中的添加文件按钮,把电脑中的视频文件添加到软件当中做转换。当然也可以拖到视频到软件中。

3、视频添加之后就可以进行其他的操作了。在软件右侧选择设置文件的片段名和视频片段的时间范围。然后就可以在预览面板中预览音频文件了。如果设置没有问题,那么可以点击确认并添加到输出列表了。 4、然后就是更换输出音频的保存位置了。点击软件中的更改路径按钮,然后在弹出的路径选择框中找到一个位置保存音频,软件是默认输出到桌面上也就是C:\Users\Desktop,选择好地址后点击选择文件夹即可成功修改。

5、然后就可以开始提取音频文件了。点击软件右下角的开始提取,然后需要等待软件将视频中的音频文件提取出来就行了。然后等到软件提取至100%,那么就可以在音频的保存路径看到了。或者点击打开按钮也能直接到达。 以上就是音频剪辑软件哪个好用了。当然迅捷音频转换器不仅能提取音频文件,还可以进行音频剪切、音频合并和音频转换等操作。

音频编解码技术的延时问题

SBC编解码器在A2DP协议里是必不可少的。由于是将信号以帧的形式填充到蓝牙数据包中,其整体延迟时间比较高,主要归于以下几个因素: 1.编解码器延迟:每个音频编解码器在将数据进行编码、解码并发出去之前会造成一定的内部延迟。传统的编解码器已检测到高达50ms的编解码器延迟。 2.传输延迟:A2DP传输层采用数据包结构。工程师在使用基于SBC或感知的帧填充数据包时,有两个方案选择:其一是将一个帧放入大型蓝牙数据包中(图1);其二是将一个帧分解成两个蓝牙数据包(图2)。采用第一个方案会降低数据传输的稳健性,而在第二个方案中,解码器只有在接收到两个蓝牙数据包以后才能对分解帧进行解码,因此将大大增加传输延迟时间。 图1

图2 apt-X是CSR 公司专有的一种编码格式,压缩率4:1(约352 kbit/s),号称可以达到CD 音质。由于是专有格式,必须要求播放设备与接受设备均采用CSR的蓝牙模块才行。 特点:无缓冲,低延迟,如果出现数据包损失的话,几乎无需重传数据。apt-X不同于SBC,它采用无框架结构。解码过程中,aptX编解码器无需等待便可高效地对蓝牙数据包进行填充,也就是说,一旦它接收到数据包便即刻启动解码过程,无需等待(图3)。此外,aptX采用固定压缩率算法,可在传输过程中始终提供相同的比特率,从而保证每个配备aptX的产品输出相同的音质。 aptX具备的一系列独特特性在提供专业的音频性能及稳健性的同时,还可保证40ms的编解码延迟。 图3 关于解码方式的一个比喻: 我们可以想象一个四车道的高速公路经过一座只有单车道的桥。使用aptX技术相当于桥头上的收费站将四车道上的车流处理(或编码)成单车道队列,使其能够穿桥而过。然后,在桥尾有另一个收费站将单车道车流又处理(或解码)回四车道。 SBC、AAC 和MP3技术的这些收费站,会限制通过车辆所允许携带的汽油量,这样每辆车都必须将超出限量的汽油放掉。当他们通过桥另一端的收费站后,虽然汽油也许不会全部用完,但肯定比来时要少很多。此外,一旦您过了桥,之前放掉的汽油不会再还给您。换句话说,您永远失去了这些汽油。对重现音频这一事件来说,相当于上述几种解码方法使用更具破坏性的压缩技术来处理音频数据,使其能通过蓝牙传输,这意味着它们将扔掉自认为不重要的音频元素,仅重现有限的音频带宽。 SBC与aptX差别: 与SBC(Sub-Band Codec子带编解码)技术相比,aptX的优势比较明显: 在频率响应方面,aptX可以在整个频率范围内真实还原音频,SBC则会随着频率的增高,信号渐弱,从而导致失真显著。

音乐剪辑合并软件哪个好用

其实现在很流行的一些抖音歌曲大部分都是用音频编辑软件进行剪辑合成处理的,使用音频剪辑软件就可以将一首歌曲的副歌部分剪辑下来这时别人就很容易能快速听到此歌曲的高潮部分无需等待。那么音频编辑软件有哪些?下面小编就给大家推荐几款简单的音频编辑软件分享给大家,希望对大家能够有所帮助。 软件一:迅捷音频转换器 迅捷音频转换器是一款专业的音频转换编辑工具,拥有音频剪切、音频提取、音频转换等多种功能,能够用多种分割方式进行音频剪切,而且支持批量操作,功能强大,操作简单,绝对是一款不容错过的软件。 软件特色

1、多种音频剪切方式 支持平均分割、时间分割、手动分割 2、产品功能丰富 支持音频剪切、音频提取、音频转换 3、支持文件批量操作 不仅支持单个文件操作,还支持文件批量操作,提高效率 软件二:audacity

audacity(audacity中文版)是一个免费开源的音频编辑软件和录音软件,可导入WAV,AIFF,AU,IRCAM,MP3及Ogg Vorbis,并支持大部份常用的工具,如剪裁、贴上、混音、升/降音以及变音特效、插件和无限次反悔操作,内置载波编辑器。audacity(音频编辑软件)支持Linux、MacOS、Windows等多平台 软件特色: 1、功能强大,录音、混音、制作特效,并支持多种格式wav,mp3,ogg 等 2、免费且开源,无需支付任何费用 3、软件自带中文,界面操作简单明了

软件三:adobe audition adobe audition 3.0中文版中灵活、强大的工具正是您完成工作之所需。改进的多声带编辑, 新的效果, 增强的噪音减少和相位纠正工具, 以及 VSTi 虚拟仪器支持仅是adobe audition 3.0中文版中的一些新功能, 这些新功能为您的所有音频项目提供了杰出的电源、 控制、生产效率和灵活性。

Biamp_Nexia数字音频处理器介绍

B i a m p N e x i a音频处理器介绍 编者案:传统扩音都是由调音台、音频处理、功放和音箱组成,设备众多,总投资不菲。而非专业音频的用户往往不会操作,刚调好的一个声场,几个月后已经是惨不忍睹。在数字化的今天,我们迎来 更加符合现代数字音视频集成工程应用的需要。 1.?前言 Biamp Nexia 于1976年在美国俄勒冈州注册,最早是生产高品质的音乐器材,紧随着专业音频技术的发展,逐步转型生产专业音频处理设备。1996年生产出第一台Audia数字媒体矩阵,2003年推出智能话筒混音器、单声道/立体声线路混音器,功率放大器系列,同年推出专门针对中小型多媒体会议系统的NEXIA系列小型媒体矩阵(PM CS SP)。当远程会议走入人们视线时,Biamp也在2006年生产了专门针对远程会议的Nexia TC&VC.基于他们生产音乐器材的背景和对声音的热爱,他们对声音有很高的要求,同时也把这样的要求应用到所有产品中,而且把高品质声音作为产品生产的第一位。应用范围很广,涉及政府、学校、公交、以及视频会议系统、体育场馆扩声工程,并享有很高的赞誉。在国际信息化产业联盟ICIA公布的最佳系统集成固定安装类产品大奖中,BIAMP公司的产品被权威期刊评为“最佳DSP处理大奖”。2003年进入中国市场,市场份额逐年上升; 你的远见可以成为现实 Nexia系列产品根据工程中遇到的现实问题而量身定做的。很多客户往往预算紧张,但对声音质量的要求却毫不妥协,并且希望联网遥控。通过创新的数字信号处理技术,Nexia以小巧的外形提供了远胜于模拟系统的解决方案。 通过标配的Nexlink接口,最多可以4台Nexia设备级联成系统,彼此交换数字音频信号,并共享DSP资源。再配合VS8这样人性化的线控面板,一个灵活而实用的数字音频系统就展现在你的面前。高雅、简洁而且功能强大,在每天的日常实用中稳定地发挥效能。 Nexia软件:易于使用、精于设计。 界面直观、操作简单、功能强大,Nexia软件允许您以搭积木的方式进行系统设计。所有的设计操作都在同一个界面下完成,无需反复在不同页面间切换。令设计、修改,甚至推翻重来这一切工作都变 为使工程项目进展更快,所有Nexia产品出厂时都包含了标准的音频系统设计,通电就能使用!如果您有特殊需求,也可以对工厂内置的系统设计进行修改,实现您的梦想! 线控组件:人性外观,简洁有效。

各种音视频编解码学习详解

各种音视频编解码学习详解 编解码学习笔记(一):基本概念 媒体业务是网络的主要业务之间。尤其移动互联网业务的兴起,在运营商和应用开发商中,媒体业务份量极重,其中媒体的编解码服务涉及需求分析、应用开发、释放license收费等等。最近因为项目的关系,需要理清媒体的codec,比较搞的是,在豆丁网上看运营商的规范标准,同一运营商同样的业务在不同文档中不同的要求,而且有些要求就我看来应当是历史的延续,也就是现在已经很少采用了。所以豆丁上看不出所以然,从wiki上查。中文的wiki信息量有限,很短,而wiki的英文内容内多,删减版也减肥得太过。我在网上还看到一个山寨的中文wiki,长得很像,红色的,叫―天下维客‖。wiki的中文还是很不错的,但是阅读后建议再阅读英文。 我对媒体codec做了一些整理和总结,资料来源于wiki,小部分来源于网络博客的收集。网友资料我们将给出来源。如果资料已经转手几趟就没办法,雁过留声,我们只能给出某个轨迹。 基本概念 编解码 编解码器(codec)指的是一个能够对一个信号或者一个数据流进行变换的设备或者程序。这里指的变换既包括将信号或者数据流进行编码(通常是为了传输、存储或者加密)或者提取得到一个编码流的操作,也包括为了观察或者处理从这个编码流中恢复适合观察或操作的形式的操作。编解码器经常用在视频会议和流媒体等应用中。 容器 很多多媒体数据流需要同时包含音频数据和视频数据,这时通常会加入一些用于音频和视频数据同步的元数据,例如字幕。这三种数据流可能会被不同的程序,进程或者硬件处理,但是当它们传输或者存储的时候,这三种数据通常是被封装在一起的。通常这种封装是通过视频文件格式来实现的,例如常见的*.mpg, *.avi, *.mov, *.mp4, *.rm, *.ogg or *.tta. 这些格式中有些只能使用某些编解码器,而更多可以以容器的方式使用各种编解码器。 FourCC全称Four-Character Codes,是由4个字符(4 bytes)组成,是一种独立标示视频数据流格式的四字节,在wav、avi档案之中会有一段FourCC来描述这个AVI档案,是利用何种codec来编码的。因此wav、avi大量存在等于―IDP3‖的FourCC。 视频是现在电脑中多媒体系统中的重要一环。为了适应储存视频的需要,人们设定了不同的视频文件格式来把视频和音频放在一个文件中,以方便同时回放。视频档实际上都是一个容器里面包裹着不同的轨道,使用的容器的格式关系到视频档的可扩展性。 参数介绍 采样率 采样率(也称为采样速度或者采样频率)定义了每秒从连续信号中提取并组成离散信号的采样个数,它用赫兹(Hz)来表示。采样频率的倒数叫作采样周期或采样时间,它是采样之间的时间间隔。注意不要将采样率与比特率(bit rate,亦称―位速率‖)相混淆。 采样定理表明采样频率必须大于被采样信号带宽的两倍,另外一种等同的说法是奈奎斯特频率必须大于被采样信号的带宽。如果信号的带宽是100Hz,那么为了避免混叠现象采样频率必须大于200Hz。换句话说就是采样频率必须至少是信号中最大频率分量频率的两倍,否则就不能从信号采样中恢复原始信号。 对于语音采样: ?8,000 Hz - 电话所用采样率, 对于人的说话已经足够 ?11,025 Hz ?22,050 Hz - 无线电广播所用采样率 ?32,000 Hz - miniDV 数码视频camcorder、DAT (LP mode)所用采样率 ?44,100 Hz - 音频CD, 也常用于MPEG-1 音频(VCD, SVCD, MP3)所用采样率

音频编解码原理讲解和分析

音频编码原理讲解和分析 作者:谢湘勇,算法部,xie.chris@https://www.wendangku.net/doc/878044201.html, 2007-10-13 简述 (2) 音频基本知识 (2) 采样(ADC) (3) 心理声学模型原理和分析 (3) 滤波器组和window原理和分析 (6) Window (6) TDAC:时域混叠抵消,time domain aliasing cancellation (7) Long and short window、block switch (7) FFT、MDCT (8) Setero and couple原理和分析 (8) 量化原理和分析 (9) mp3、AAC量化编码的过程 (9) ogg量化编码的过程 (11) AC3量化编码的过程 (11) Huffman编码原理和分析 (12) mp3、ogg、AC3的编码策略 (12) 其他技术原理简介 (13) 比特池技术 (13) TNS (13) SBR (13) 预测模型 (14) 增益控制 (14) OGG编码原理和过程详细分析 (14) Ogg V orbis的引入 (14) Ogg V orbis的编码过程 (14) ogg心理声学模型 (15) ogg量化编码的过程 (16) ogg的huffman编码策略 (17) 主要音频格式编码对比分析 (19) Mp3 (19) Ogg (20) AAC (21) AC3 (22) DRA(A VS内的中国音频标准多声道数字音频编码) (23) BSAC,TwinVQ (24) RA (24) 音频编码格式的对比分析 (25) 主要格式对比表格如下 (26) 语音编码算法简介 (26) 后处理技术原理和简介 (28) EQ (28)

(完整版)数字音频处理

数字语音实验 吕佩壕 10024134 一、实验要求 1.编程实现一句话语音的短时能量曲线,并比较窗长、窗口形状(以直 角窗和和哈明窗为例)对短时平均能量的影响 ; 2. 编程分析语音信号的短时谱特性,并比较窗长、窗口形状(以直角窗 和和哈明窗为例)对语音短时谱的影响 ; 3. 运用低通滤波器、中心削波和自相关技术估计一段男性和女性语音信 号的基音周期,画出基音轨迹曲线,给出估计准确率。 二、实验原理及实验结果 1.窗口的选择 通过对发声机理的认识,语音信号可以认为是短时平稳的。在5~50ms 的范围内,语音频谱特性和一些物理特性参数基本保持不变。我们将每个短时的语音称为一个分析帧。一般帧长取10~30ms 。我们采用一个长度有限的窗函数来截取语音信号形成分析帧。通常会采用矩形窗和汉明窗。图1.1给出了这两种窗函数在窗长N=50时的时域波形。 图1.1 矩形窗和hamming 窗的时域波形 矩形窗的定义:一个N 点的矩形窗函数定义为如下: {1,00,()n N w n ≤<=其他 Hamming 窗的定义:一个N 点的hamming 窗函数定义为如下: 0.540.46cos(2),010,()n n N N w n π-≤<-??? 其他 = 这两种窗函数都有低通特性,通过分析这两种窗的频率响应幅度特性可以发 0.2 0.40.60.811.2 1.41.61.82矩形窗 sample w (n ) 0.1 0.20.30.40.50.6 0.70.80.91hanming 窗 sample w (n )

现(如图1.2):矩形窗的主瓣宽度小(4*pi/N ),具有较高的频率分辨率,旁瓣峰值大(-13.3dB ),会导致泄漏现象;汉明窗的主瓣宽8*pi/N ,旁瓣峰值低(-42.7dB ),可以有效的克服泄漏现象,具有更平滑的低通特性。因此在语音频谱分析时常使用汉明窗,在计算短时能量和平均幅度时通常用矩形窗。表1.1对比了这两种窗函数的主瓣宽度和旁瓣峰值。 图1.2 矩形窗和Hamming 窗的频率响应 2.短时能量 由于语音信号的能量随时间变化,清音和浊音之间的能量差别相当显著。因此对语音的短时能量进行分析,可以描述语音的这种特征变化情况。定义短时能量为: 2 2 1 [()()] [()()]n n m m n N E x m w n m x m w n m ∞ =-∞ =-+= -= -∑∑ ,其中N 为窗长 特殊地,当采用矩形窗时,可简化为: 2 () n m E x m ∞ =-∞ = ∑ 图2.1和图2.2给出了不同矩形窗和hamming 窗长,对所录的语音“我是吕佩壕”的短时能量函数: (1)矩形窗(从上至下依次为“我是吕佩壕”波形图,窗长分别为32,64,128,256,512的矩形窗的短时能量函数): 00.10.20.3 0.40.50.60.70.80.91 -80 -60-40-20 0矩形窗频率响应 归一化频率(f/fs)幅度/d B 00.10.20.3 0.40.50.60.70.80.91 -100 -50 Hamming 窗频率响应 归一化频率(f/fs) 幅度/d B